五角大楼的最后通牒:Anthropic面临72小时生死抉择

原文作者:Ada,深潮 TechFlow

2月24日,星期二。华盛顿,五角大楼。

Anthropic CEO Dario Amodei坐在国防部长Pete Hegseth对面。据NPR和CNN多家媒体援引知情人士透露,会面的气氛“礼貌”,但内容一点都不客气。

Hegseth给了他一个最后通牒:周五下午5:01之前,放开Claude的军事使用限制,允许五角大楼将其用于“所有合法用途”,包括自主武器瞄准和国内大规模监控。

否则取消2亿美元合同。启动《国防生产法》,强制征用。将Anthropic列为“供应链风险”,这等同于把它归入俄罗斯和中国敌对实体的黑名单。

同一天,Anthropic发布了第三版“负责任扩展政策”(RSP 3.0),悄悄删掉了公司成立以来最核心的一条承诺:如果无法保证安全措施到位,就不训练更强大的模型。

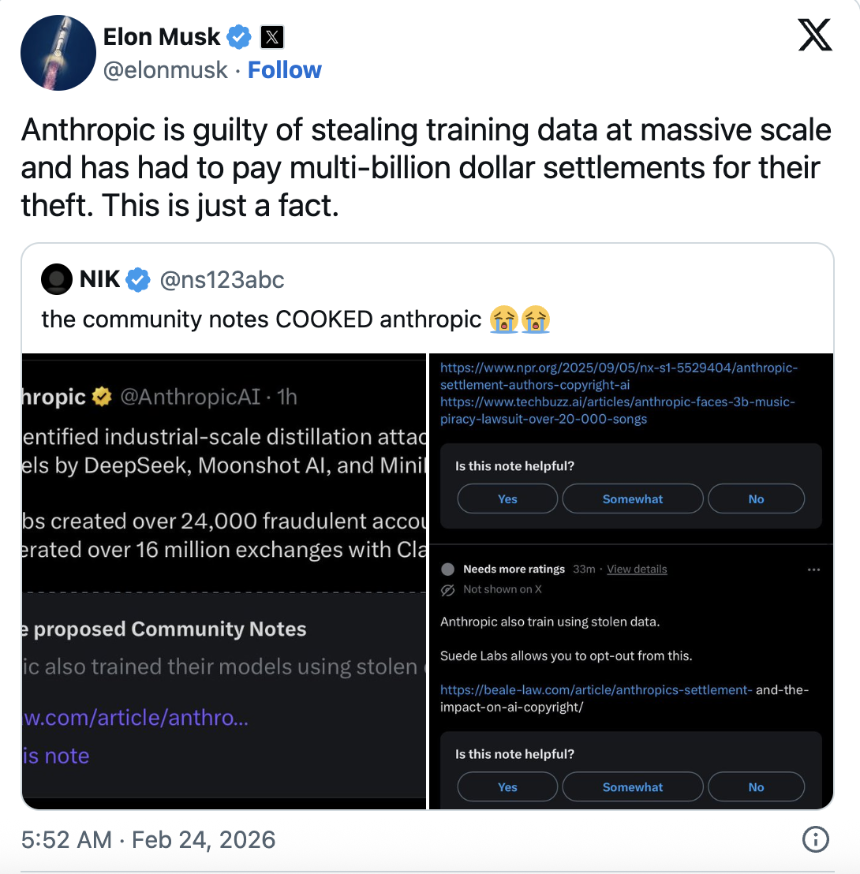

也是同一天,Elon Musk在X上发帖说:“Anthropic大规模窃取训练数据,这是事实。”同时,X的社区笔记补充了Anthropic因使用盗版书籍训练Claude而支付15亿美元和解金的报道。

七十二小时内,这家自称有“灵魂”的AI公司,同时扮演了三个角色:安全殉道者、知识产权窃贼、五角大楼的叛徒。

哪个才是真的?

也许都是。

五角大楼的“要么服从,要么滚”

故事的第一层很简单。

Anthropic是第一家获得美国国防部机密级访问权限的AI公司。去年夏天拿到的合同,上限2亿美元。OpenAI、Google、xAI随后也各拿了同等规模的合同。

据Al Jazeera报道,Claude曾被用于今年1月的一次美军行动。报道称该行动涉及委内瑞拉总统马杜罗的绑架。

但Anthropic划了两条红线:不支持全自主武器瞄准,不支持对美国公民的大规模监控。Anthropic认为,人工智能的可靠性不足以操控武器,而且目前还没有任何法律法规规范人工智能在大规模监控中的应用。

五角大楼不买账。

白宫AI顾问David Sacks去年10月在X上公开指控Anthropic“以恐惧为武器,搞监管俘获”。

竞争对手已经跪了。OpenAI、Google、xAI都同意让军方将其AI用于“所有合法场景”。Musk的Grok本周刚获批进入机密系统。

Anthropic是最后一个站着的。

截至发稿,Anthropic在最新发表的声明中表示,他们并没有打算让步。但周五5:01的大限,已经近在眼前。

一位匿名的前司法部与国防部联络员对CNN表示了困惑:“你怎么能同时宣布一家公司是‘供应链风险’,又强迫这家公司为你的军队工作?”

好问题,但这不在五角大楼考虑范围之内。他们在乎的是,如果Anthropic不妥协,将采取强制手段,或者,成为华盛顿弃儿。

“蒸馏攻击”:一场打脸式的控诉

2月23日,Anthropic发了一篇措辞激烈的博客,指控三家中国AI公司对Claude进行了“工业级蒸馏攻击”。

被告是DeepSeek、Moonshot AI、MiniMax。

Anthropic指控它们通过2.4万个伪造账户,对Claude发起超过1600万次交互,定向提取Claude在智能体推理、工具调用和编程方面的核心能力。

Anthropic把这件事定性为国家安全威胁,声称蒸馏后的模型“不太可能保留安全护栏”,可能被威权政府用于网络攻击、虚假信息和大规模监控。

叙事很完美,时机也很完美。

恰好在特朗普政府刚刚放宽对华芯片出口管制之后,恰好在Anthropic需要为自己的芯片出口管制游说立场寻找弹药的时候。

但是Musk开了一枪:“Anthropic大规模窃取训练数据,还为此支付了数十亿美元和解金。这是事实。”

AI基础设施公司IO.Net联合创始人Tory Green表示:“你们用全网的数据训练自己的模型,然后别人用你们的公共API学习你们,就叫'蒸馏攻击'了?”

Anthropic把蒸馏叫“攻击”,但这件事在AI行业是家常便饭。OpenAI用它压缩GPT-4,Google用它优化Gemini,连Anthropic自己也在做。唯一的区别是,这次被蒸的是它自己。

据新加坡南洋理工大学AI教授Erik Cambria对CNBC表示:“合法使用和恶意利用之间的边界往往是模糊的。”

更讽刺的是,Anthropic刚为使用盗版书籍训练Claude支付了15亿美元和解金。它用全网的数据训练模型,然后指控别人用它的公开API学习它。这不是双标,这是三标。

Anthropic本想扮演受害者,结果被扒成了被告。

安全承诺的拆除:RSP 3.0

就在与五角大楼对峙、与硅谷互撕的同一天,Anthropic发布了第三版负责任扩展政策。

Anthropic首席科学家Jared Kaplan在接受媒体采访时表示:“我们觉得停止训练AI模型对任何人都没有帮助。在AI快速发展的背景下,单方面做出承诺……而竞争对手在全速推进,这没有意义。”

换句话说,别人不讲武德,我们也不装了。

RSP 1.0和2.0的核心是一条硬性承诺,如果模型的能力超过了安全措施的覆盖范围,就暂停训练。这条承诺让Anthropic在AI安全圈获得了独一无二的声誉。

但3.0删了。

取而代之的是一个更“灵活”的框架,即把Anthropic自己能做的安全措施和需要全行业协作的安全建议分成两条轨道。每3-6个月发一份风险报告。请外部专家审阅。

听起来很负责?

来自非营利组织METR的独立审查员Chris Painter在看完政策早期草案后对表示:“这说明Anthropic认为需要进入'分诊模式',因为评估和缓解风险的方法跟不上能力增长的速度。这更多地证明了社会对AI潜在灾难性风险没有做好准备。”

根据TIME报道,Anthropic花了将近一年时间内部讨论这次改写,CEO Amodei和董事会全票通过。官方说法是,原来的政策设计初衷是推动行业共识,结果行业根本没跟上。特朗普政府对人工智能发展采取了放任自流的态度,甚至试图废除各州的相关法规。联邦层面的人工智能法律遥遥无期。尽管在2023年建立全球治理框架似乎还有可能,但三年过去了,这扇门显然已经关闭。

一位长期跟踪AI治理的匿名研究员说得更直接:“RSP是Anthropic最值钱的品牌资产。删掉暂停训练承诺,就像一家有机食品公司悄悄把'有机'两个字从包装上撕下来,然后告诉你他们现在的检测更透明了。”

3800亿估值下的身份撕裂

2月初,Anthropic以3800亿美元估值完成300亿美元融资,亚马逊是锚定投资者。自成立以来,就实现了140亿美元的年化收入。过去三年,这一数字每年都增长超过10倍。

同时,五角大楼威胁将其列入黑名单。Musk公开指控其数据盗窃。自己的核心安全承诺被删除。Anthropic的人工智能安全负责人Mrinank Sharma辞职后在X上写道:“世界正处于危险之中。”

矛盾?

或许矛盾是Anthropic的基因。

这家公司由前OpenAI高管创立,因为他们担心OpenAI在安全问题上走得太快。然后他们自己建了一家公司,以更快的速度构建更强大的模型,同时告诉全世界这些模型有多危险。

商业模式可以概括为一句话,我们比任何人都更害怕AI,所以你应该出钱让我们来造AI。

这个叙事在2023-2024年完美运转。AI安全是华盛顿的热词,Anthropic是最受欢迎的游说者。

2026年,风向变了。

“woke AI”成了攻击标签,州级AI监管法案被白宫阻击,Anthropic支持的加州SB 53虽然签署成法,但联邦层面一片荒芜。

Anthropic的安全牌,正在从“差异化优势”滑向“政治负资产”。

Anthropic在做一个复杂的平衡术,它需要足够“安全”来维持品牌,又需要足够“灵活”来不被市场和政府抛弃。问题是,两头的容忍空间都在缩小。

安全叙事,还值多少钱?

把三件事叠在一起看,画面就清楚了。

指控中国公司蒸馏Claude,是为了强化芯片出口管制的游说叙事。为了在军备竞赛中不掉队,删除了安全暂停承诺。拒绝五角大楼的自主武器要求,是为了保住最后一层道德外衣。

每一步都有逻辑,但每一步之间又互相矛盾。

你不能一边说中国公司“蒸馏”你的模型会危害国家安全,一边删掉防止你自己的模型失控的承诺。如果模型真的那么危险,你应该更谨慎,而不是更激进。

除非你是Anthropic。

在AI行业,身份不是由你的声明定义的,是由你的资产负债表定义的。Anthropic的“安全”叙事,本质上是一种品牌溢价。

在AI军备竞赛的早期,这种溢价值钱。投资者愿意为“负责任的AI”支付更高的估值,政府愿意为“可信赖的AI”开绿灯,客户愿意为“更安全的AI”付费。

但2026年,这个溢价正在蒸发。

Anthropic现在面临的,不是“要不要妥协”的选择题,而是“先向谁妥协”的排序题。向五角大楼妥协,品牌受损。向竞争对手妥协,安全承诺作废。向投资者妥协,两头都得让。

周五下午5:01,Anthropic会交出它的答案。

但无论答案是什么,有一件事已经确定:那个曾经靠“我们和OpenAI不一样”立足的Anthropic,正在变得和所有人一样。

身份危机的终点,往往是身份的消失。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯