被封禁48小时后,Claude逆袭登顶App Store免费榜

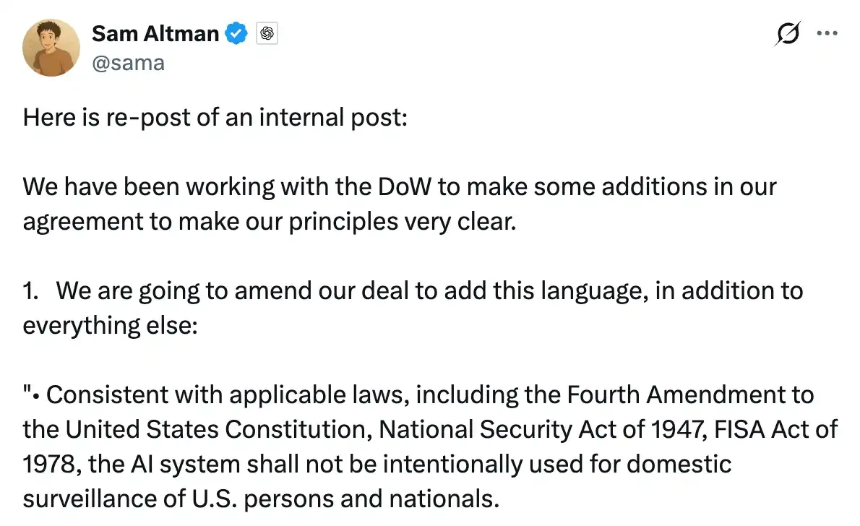

周六清晨,奥特曼在 X 平台转发了一封内部信截图。

这封信是他周四深夜写给 OpenAI 员工的,提到公司正与五角大楼谈判,并希望借此「缓和局势」。他在转发时附上说明,试图公开解释这几天发生的事情。

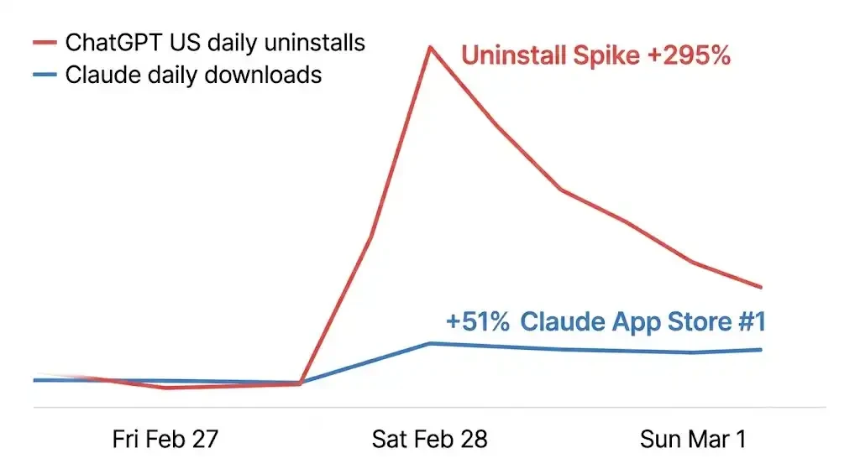

就在他发出这条推文时,Claude 已经在美国 App Store 的免费榜上跃居第一。而就在前一天,这个位置还属于 ChatGPT。

Sensor Tower 数据显示,随后几小时内,ChatGPT 在美国的日卸载量暴增 295%,1 星差评激增 775%。与此同时,Claude 的下载量单日上涨 51%。Reddit 上掀起「Cancel ChatGPT」(抵制 ChatGPT)的讨论浪潮,用户纷纷晒出取消订阅的截图,有人评论称「这是我安装软件最快的一次」。一个名为 QuitGPT.org 的网站上线,声称已有 150 万人采取行动。

周一,由于涌入的用户过多,Claude 出现了大规模宕机。这家被联邦政府列为「供应链安全风险」的公司,因服务器不堪重负而暂时瘫痪。

精准的产品反击

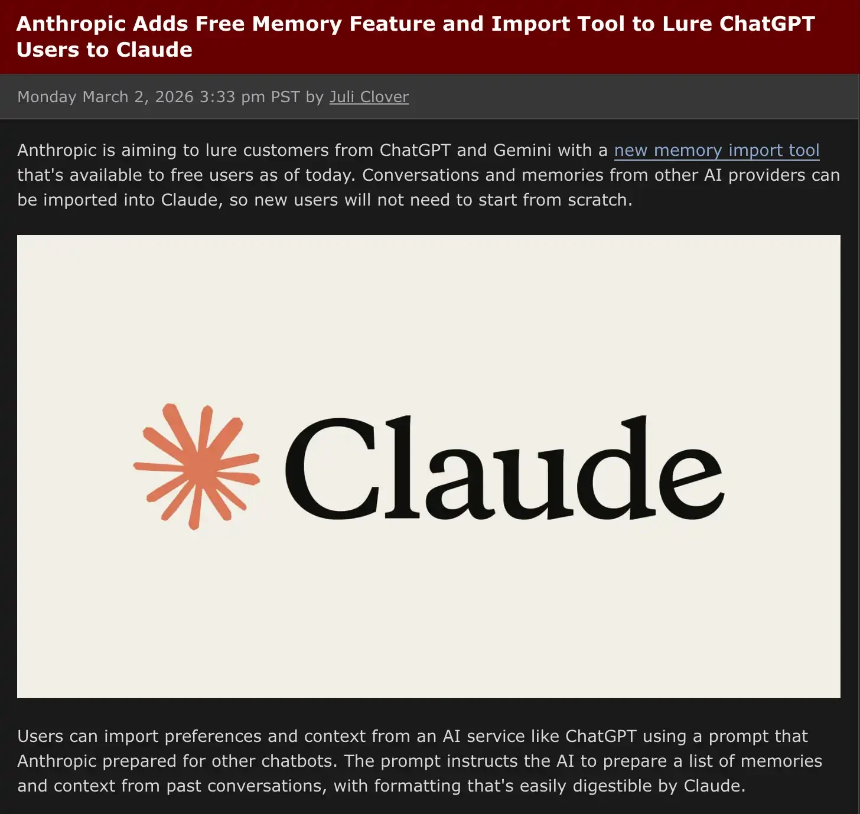

在 ChatGPT 卸载潮发酵的同一天,Anthropic 推出了记忆迁移工具。

这项功能并不复杂:用户只需将一段提示词复制到 ChatGPT 中,让其输出所有存储的记忆和偏好,然后粘贴到 Claude,即可一键导入,继续之前的对话。官网文案简洁明了:「switch to Claude without starting over」。

这款工具的关键在于推出的时机。

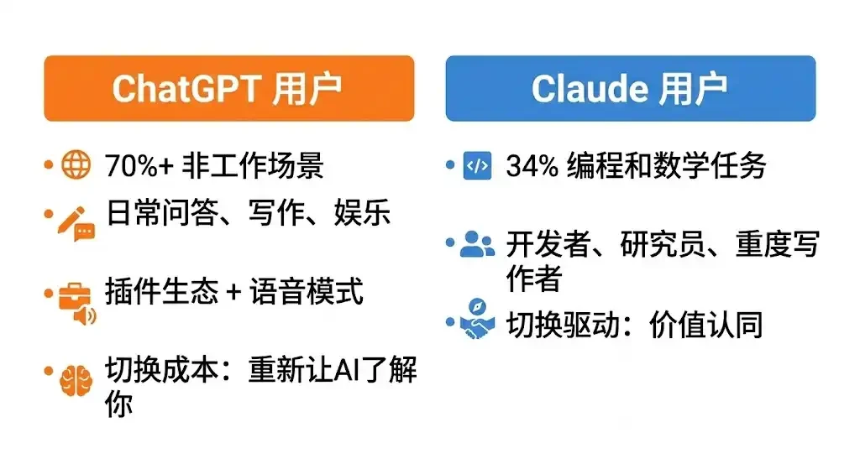

OpenAI 自己的数据显示,截至 2025 年中,ChatGPT 用户超过 70% 的使用场景是非工作相关的,包括日常问答、写作、娱乐和信息查找等。作为许多人接触的第一个 AI 工具,ChatGPT 凭借庞大的插件生态、Voice Mode 和深度集成的第三方应用嵌入了用户的日常生活。对于这些用户而言,切换成本不仅仅是「下载一个新 App」,而是重新让一个陌生的 AI 了解自己是谁。记忆的积累,曾是用户留下的最强理由。

Anthropic 的研究数据则显示,Claude 的使用场景高度集中:编程和数学任务占 34%,是单一最大类别;教育和科研则是过去一年增长最快的领域。其核心用户群体为开发者、研究人员和重度写作者,他们更理性,更容易因为明确的价值判断更换工具,只要迁移成本足够低。

记忆迁移工具将这一成本压至最低。同时,Anthropic 宣布向免费用户全面开放记忆功能,此前这一功能仅为付费专属。

然而,这波涌入的用户中,相当一部分并非 Claude 的目标用户。

从社交媒体反馈来看,许多从 ChatGPT 迁移过来的普通用户,在首次使用 Claude 时的感受往往是:「它不一样。」有人认为 Claude 的回答更有深度,会主动提出质疑,而不是一味迎合。有人发现它在写作上更加干净,但无法生成图片,也没有 Voice Mode 那样的互动体验。

一些用户原本想找一个「更听话的 ChatGPT 替代品」,却发现自己需要时间适应 Claude 更强的个性。TechRadar 的一篇迁移指南在这两天被广泛转发,标题为「我希望当初有人告诉我这些事」,文章的核心观点是:Claude 和 ChatGPT 的使用逻辑截然不同,前者更像是一个有立场的工作伙伴,后者则是一个万能助手。

这种差异本是两个产品的定位,却被这次事件意外放大。用户因道德立场选择 Claude,却发现了一个与预期不同的产品——一个更挑剔、更有边界感的 AI。这本可能导致流失,但在当前特殊的时间节点上,反而成为留下的理由:当用户认同一家公司的立场时,更容易接受其产品的逻辑。

推出数日后,Anthropic 公布数据:免费活跃用户相比 1 月增长超 60%,日新增注册量翻了四倍。Claude 因访问量过大一度宕机,数千名用户报告无法登录,问题在几小时内修复。

合同里的三个字:OpenAI 说了什么,又做了什么

Anthropic 是首家将 AI 模型部署到美国军方机密网络的商业公司,合作通过 Palantir 完成,合同价值约 2 亿美元。然而,过去数月,双方关系持续恶化。争议核心在于一个条款:五角大楼要求 AI 模型开放「所有合法用途」,不附加任何条件。Anthropic 则坚持写明两条例外:不得用于大规模监控美国公民,不得用于完全自主武器系统。

2 月 20 日前后,据报道,Anthropic 一名高管就 1 月美军抓捕委内瑞拉总统马杜罗行动中 Claude 的使用方式,向合作方 Palantir 提出质询,军方对此表示强烈不满。周四,五角大楼下达最后通牒,限 Dario Amodei 当天下午 5 点前给出答复。

Amodei 在截止时间前发表声明,称公司无法接受当前条款,「不是因为我们反对军事用途,而是在少数情况下,我们相信 AI 有可能破坏而非捍卫民主价值」。特朗普随即宣布联邦机构六个月内全面停用 Anthropic 产品,Hegseth 将其列为「供应链安全风险」,这一标签通常用于外国对手公司。合同就此终止。

空出来的位置很快有人填补。就在同一天晚些时候,OpenAI 宣布与五角大楼签约。奥特曼在周四的内部信中立场清晰,他写道这已经是「整个行业的问题」,并称 OpenAI 和 Anthropic 持有相同的「红线」:反对大规模监控,反对自主武器。周五,协议达成,将在军方机密网络部署模型,限制只能在云端运行,派驻工程师监督,并声称已在合同里写明了相同的两条限制。

奥特曼随后在 X 上开放提问,解答了数小时。有人问他:为什么五角大楼接受了 OpenAI,却封禁了 Anthropic?他的回答是:「Anthropic 似乎更专注于合同里的具体禁止条款,而不是引用适用的法律,而我们对引用法律感到满意。」

这句话表面上说的是方法论差异,但实际上揭示了事件的核心争议。

Anthropic 谈崩的关键在于五角大楼坚持写入的那个短语:AI 系统可用于「all lawful purposes」,即所有合法目的。Anthropic 拒绝的理由是,这个短语在国家安全语境下并不是固定边界。现行法律在很多方面尚未跟上 AI 的能力,「合法」的范围将由政府自己的解释决定。OpenAI 签署了这一短语,同时声称在合同里谈到了相同的保护。

法律专家随后对 OpenAI 公开的合同条款进行了分析,指出了两处具体的表述问题。

监控条款规定,系统不得用于「unconstrained」(无约束的)监控美国公民私人信息。民主与技术中心政策副总裁 Samir Jain 指出,这里的措辞意味着「有约束的」监控版本是被允许的。而在现行法律框架下,政府完全可以从数据经纪商合法购买公民的位置记录、浏览历史和金融数据,让 AI 来分析这些数据,在技术上不构成「非法监控」。Amodei 在随后接受 CBS 采访时举的正是这个例子。

武器条款规定,系统不得在「法律、法规或部门政策要求人类控制的情况下」用于自主武器。这个限定语意味着,限制只在其他规定已经要求人类控制的前提下才生效,约束力完全依赖现有政策。而五角大楼有权随时修改自己的内部政策。法律学者 Charles Bullock 在 X 上写道,合同里的武器条款依赖的是 DoD 指令 3000.09,该指令要求指挥官保留「适当程度的人类判断」,而这个「适当程度」是一个可以被灵活解释的标准。

OpenAI 对这些质疑的回应是:模型只能在云端运行,这从架构上排除了被直接集成进武器系统的可能。合同里也写明了具体的法律依据,比文字性禁止条款更有约束力,因为法律是已经经过检验的框架。奥特曼自己也在答问中承认:「如果我们将来需要打这场仗,我们会打,但这显然让我们面临一些风险。」

这不是两家公司一个愿意妥协、一个坚守原则的问题,而是两种根本不同的安全哲学。OpenAI 的底线是:非法的事我不做。Anthropic 的底线是:法律还没来得及禁止、但我认为不该做的事,我也不做。

这个分歧在 OpenAI 内部也留下了裂缝。上周,多名 OpenAI 员工签署公开信,支持 Anthropic 的立场,反对将其列为供应链风险。对齐研究员 Leo Gao 公开质疑公司合同是否提供了足够的保护。OpenAI 旧金山办公室外的人行道出现了用粉笔写成的批评涂鸦。Anthropic 办公室外则是支持性的留言。奥特曼那场持续数小时的 X 答问,很大程度上面向的是自己公司内部那些本来站在 Anthropic 一边的人。

同一套叙事的两个结果

Anthropic 多年来一直以「防止文明级风险」为核心框定自己的安全使命,将前沿 AI 的潜在威胁与核武器相提并论,把自己定位为这道防线上的守门人。这套叙事是其品牌的核心,也是其在资本市场上获取信任的方式。

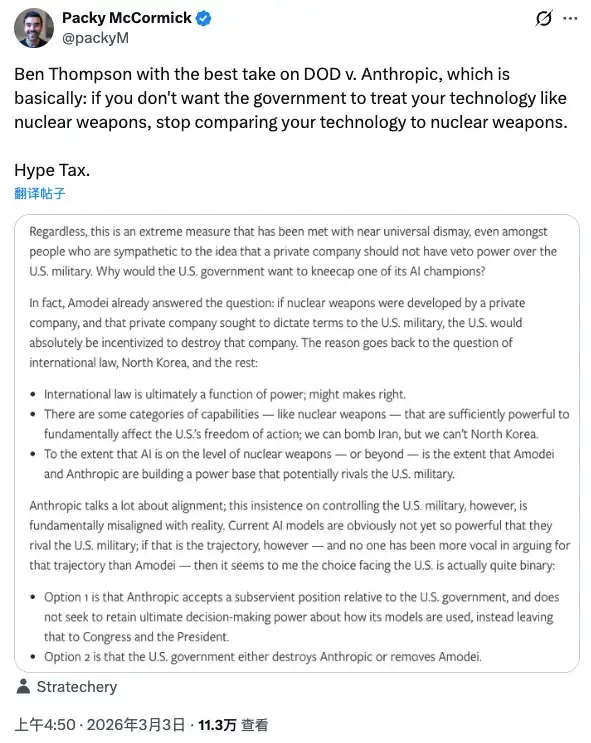

科技评论人 Packy McCormick 在这件事发酵期间引述了 Ben Thompson 的一个概念:Hype Tax。意思是,如果你用极端叙事来建立自己的影响力,那么当这套叙事遇到真正的权力时,你就要为它付账。你把 AI 技术比作核武器,政府就会用对待核武器的方式对你。

Anthropic 为这套叙事付出了代价:失去了一份合同,被列为安全风险,被总统点名,旗下所有产品被要求在六个月内从联邦系统中清除。

但在同一个周末,同一套叙事在另一个维度上产生了完全相反的效果。

普通用户看到的不是合同条款,不是法律解释,不是安全哲学的争论。他们看到的是:一家公司说不,被政府踢出去了。另一家公司说好,拿到了合同。他们用自己的判断框架做出了选择,295% 的卸载量,App Store 第一,宕机的服务器。

这是 AI 行业史上少见的消费者集体道德表态。

Anthropic 没有花一分钱公关预算在这件事上。Amodei 的声明措辞克制,没有呼吁用户支持,没有点名 OpenAI,没有把自己塑造成殉道者。但结果发生了。

这里有一个值得注意的细节:那场让用户涌向 Claude 的事件,本质上是 OpenAI 做了一件在商业上完全合理的事——在竞争对手被封禁、合同悬空的时候签下协议,并声称谈到了相同的保护条款。奥特曼也明确表示,他这样做部分是为了帮助局势降温,防止对 Anthropic 进一步的伤害。

无论动机如何,结果是 OpenAI 拿到了合同,Anthropic 的用户增长了。两边都有代价,两边都有收益,只是计量单位不同。

还有一件事值得放在这里。

Anthropic 失去的五角大楼合同,价值约 2 亿美元。

Anthropic 目前的年化收入为 140 亿美元,目标是在 2026 年内达到 260 亿美元。

Anthropic 上个月刚刚完成 300 亿美元的 E 轮融资,估值 3800 亿美元。

这笔账,现在不难算。但还有另一个问题没有答案:当 AI 真的被大规模用于军事决策,那些写进合同里的「技术护栏」和派驻的工程师,到底能不能管用,无论是 OpenAI 的,还是 Anthropic 原本要求的那些。

这个问题,不在任何已经公开的合同里。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯