黄仁勋点名的SN3:分布式AI训练新里程碑,背后的技术与争议

原文作者:KarenZ,Foresight News

2026年3月20日,All-In创投播客中的一场对话引发了广泛关注。风投大佬Chamath Palihapitiya向英伟达CEO黄仁勋提及了一个名为Bittensor的项目,称其完成了一项“相当疯狂的技术成就”——用分布式算力在互联网上训练了一个大型语言模型,过程完全去中心化,没有任何中心化的数据中心参与。

黄仁勋并未回避这一话题,而是将其类比为“Folding@home的现代版本”,即那个在2000年代让普通用户贡献闲置算力、共同对抗蛋白质折叠难题的分布式项目。

几天前的3月16日,Anthropic联合创始人Jack Clark在其AI研究进展报告中也重点提到了这项突破:Bittensor生态子网Templar(SN3)完成了720亿参数大模型(Covenant 72B)的分布式训练,性能与Meta 2023年发布的LLaMA-2相当。

Jack Clark将这一章节命名为“通过分布式训练挑战AI政治经济学”,并强调这是一项值得持续追踪的技术。他设想了一个未来:设备端AI大量采用去中心化训练产出的模型,而云端AI则继续运行专有大模型。

市场的反应滞后但剧烈:SN3过去一个月涨幅超过440%,过去两周涨幅逾340%,市值达到1.3亿美元。子网叙事的爆发直接传导为TAO的购买压力,TAO一度涨至377美元,过去一个月翻倍,FDV达到约75亿美元。

那个72B的模型

要理解SN3为何被推至聚光灯下,需先看清楚其成绩单。

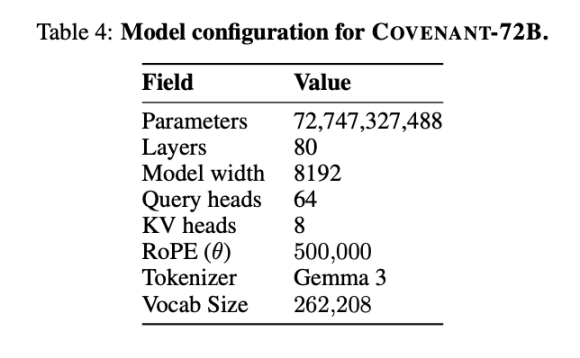

2026年3月10日,Covenant AI团队在arXiv发布技术报告,正式宣布Covenant-72B完成训练。这是一个720亿参数的大型语言模型,由超过70个独立节点(每轮约20个节点同步,每个节点配备8张B200)在约1.1万亿tokens的语料上完成预训练。

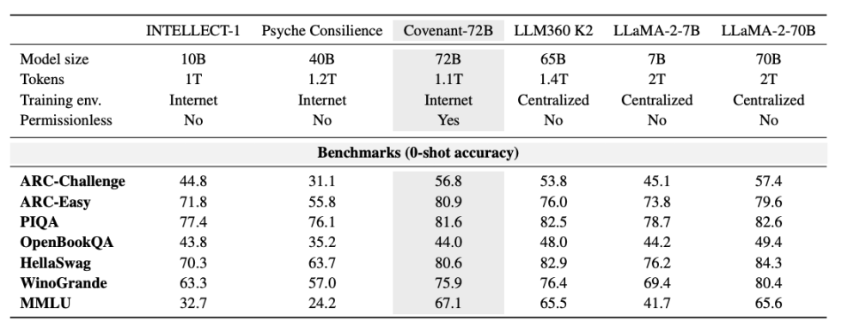

Templar在基准测试中给出了一些数据,对比的是Meta 2023年发布的LLaMA-2-70B。正如Jack Clark所言,Covenant-72B放在2026年可能显得过时。Covenant-72B在MMLU上的得分为67.1分,大致对标LLaMA-2-70B的65.6分。

然而,2026年的前沿模型——无论是GPT系列、Claude还是Gemini——早已在数十万块GPU上完成了参数量远超1000亿的训练,推理、代码、数学能力的差距是数量级而非百分比的问题。这个现实差距不应被市场情绪淹没。

但在“用开放互联网上的分布式算力训练出来”的前提下,意义完全不同。

做个比较:同为去中心化训练的INTELLECT-1(Prime Intellect团队出品,100亿参数)MMLU得分32.7;另一个白名单参与者中的分布式训练项目Psyche Consilience(400亿参数)得分24.2。Covenant-72B以72B的规模和67.1的MMLU分数,在去中心化训练赛道中表现亮眼。

更重要的是,这次训练是“无需许可”的。任何人都可以接入成为参与节点,不需要事先审核或白名单。超过70个独立节点从全球各地连接贡献算力。

黄仁勋说了什么,没说什么

还原那场播客对话的细节,有助于校正外界对这次“背书”的解读。

Chamath Palihapitiya将Bittensor的技术成就呈现给黄仁勋,并描述为用分布式算力训练了一个Llama模型,过程“完全分布式,同时保持状态”。黄仁勋将其比作“现代版的Folding@home”,并讨论了开源与专有模型并存的必要性。

值得注意的是,黄仁勋没有直接提到Bittensor的代币或任何投资含义,也没有进一步讨论去中心化AI训练。

理解Bittensor子网和SN3

要理解SN3的突破,首先需明确Bittensor及其子网的运作逻辑。简单来说,Bittensor可视为一条AI公链和平台,而每个子网相当于一条独立的“AI生产流水线”,各自明确核心任务、设计激励机制,协同构成去中心化AI生态。

其运作流程清晰且去中心化:子网所有者定义目标并编写激励模型;矿工提供算力完成AI相关任务;验证者评估矿工贡献并上传评分至共识层;最终,Yuma共识算法根据奖励分配收益。

目前Bittensor上有128个子网,覆盖推理、无服务器AI云服务、图像、数据标注等各类任务。

而SN3就是其中一个子网,它直接瞄准了AI产业链中最贵、最封闭的核心环节之一:大模型预训练本身。

SN3希望利用Bittensor网络协调异构计算资源,通过激励式分布式大模型训练,证明无需昂贵的中心化超级计算机集群,同样可以训练出强大的基础模型。其核心吸引力在于“平权”——打破中心化训练的资源垄断,让普通个体或中小机构也能参与。

推动SN3发展的核心力量是Templar,其背后团队为Covenant Labs。该团队还运营着另外两个子网:Basilica(SN39,专注计算服务)和Grail(SN81,专注RL后训练与模型评估)。三个子网形成垂直整合,完整覆盖了大模型从预训练到对齐优化的全流程。

具体而言,矿工贡献计算资源,将梯度更新上传至网络;验证者评估每位矿工的贡献质量,按照误差改善幅度给予评分。结果决定奖励权重,自动分配,无需信任第三方。

激励机制的关键是,奖励直接挂钩“你的贡献让模型变好了多少”,而非单纯的算力出勤。这就解决了去中心化场景中最难的问题:如何防止矿工摸鱼。

那么,Covenant-72B如何解决通信效率和激励相容问题?

让几十个互不信任、硬件各异、网络质量参差不齐的节点协同训练同一个模型,挑战有两个:一是通信效率,二是激励相容。

SN3用两个核心组件解决了这两个问题:SparseLoCo和Gauntlet。

SparseLoCo解决通信效率问题。传统分布式训练每步都要同步完整梯度,数据量巨大。SparseLoCo的方案是:每个节点本地跑完30步优化,然后压缩伪梯度上传。压缩方式包括Top-k稀疏化、误差反馈和2位量化,最终压缩比超过146倍。

Gauntlet解决激励相容问题。它运行在Bittensor区块链上,负责验证每个节点提交的伪梯度质量。具体方式是:用小批数据测试“用上这个节点的梯度后,模型损失降低了多少”,结果称为LossScore。同时,系统检查节点是否在用自己分配的数据训练。

去中心化AI的价值叙事正在转变

从技术和行业视角看,Covenant-72B代表的方向有几个真实的意义。

第一,打破了“分布式训练只适合小模型”的预设。尽管与前沿模型还有差距,但证明了方向的可扩展性。

第二,无许可参与是可行的。此前的分布式训练依赖白名单,SN3实现了真正去中心化的一步。

第三,Bittensor的dTAO机制让子网价值的市场发现成为可能。这为像SN3这样产出了具体成果的子网提供了价值捕获机制。

第四,去中心化AI训练的政治经济含义。当前前沿模型训练被少数机构垄断,分布式训练可能在某些模型类型上形成去中心化的开发生态。

小结:一个真实的里程碑,以及一堆真实的问题

黄仁勋称其为“现代版的Folding@home”。SN3验证了分布式训练的可行性,但背后仍有许多问题:

MMLU本身的争议性。公开基准存在泄露风险,论文对标的LLaMA-2-70B已是老模型。

高质量数据的寡头结构。算力民主化了,但数据端依然是寡头结构。

安全性问题。无许可参与意味着节点匿名,可能存在数据投毒隐患。

代币估值逻辑的脆弱性。持有SN3代币分享的是未来训练产出的排放收益,而非模型使用的直接收益。

这些问题并非否定Covenant-72B的意义,而是提醒我们:做到了,和它意味着什么,是两件不同的事情。

参考链接:

https://arxiv.org/pdf/2603.08163

https://importai.substack.com/p/importai-449-llms-training-other

https://docs.tplr.ai/

https://systems-analysis.ru/int/MMLU_Benchmark_%E2%80%94_MMLU_%E5%9F%BA%E5%87%86%E6%B5%8B%E8%AF%95

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯