AI购物与支付:人类法律与技术准备不足

AI 购物,Amazon 说不

想象一下:你跟 AI 说,「帮我找一双 120 美元以下、适合扁平足、评价最好的跑步鞋」,然后它自动访问 Amazon、Walmart、Nike,比完价格、读完评价、过滤掉商家的广告推荐,直接下单。整个过程你不需要点一下屏幕。

是不是很美好?很省钱?

这不是想象,这是已经发生的现实。

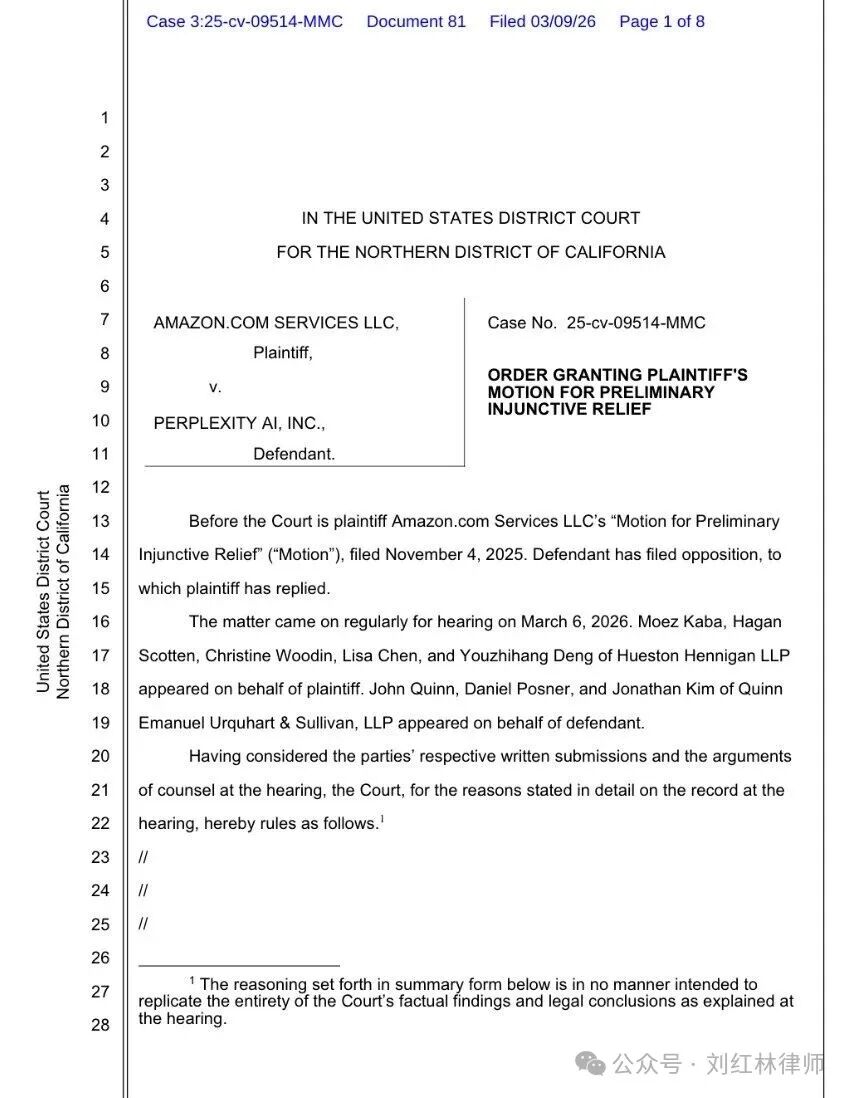

Perplexity 上线了一个叫「Comet」的功能,就是这样工作的。但 Amazon 很快把 Perplexity 告上了法院。

2026 年 3 月 9 日,美国华盛顿西区联邦法院给 Amazon 发了一个临时禁令,禁止 Comet 访问 Amazon 站点。一周后,第九巡回上诉法院暂缓了这个禁令。Comet 恢复了,但官司才刚开始打。

表面上打的是法律,实际上打的是广告

这场仗,表面上是技术纠纷,实际上打的是一个很根本的问题:当人类授权一个 AI 替他花钱,平台有没有权利把 AI 拒之门外?

Amazon 的法律依据是 1986 年的《计算机欺诈与滥用法案》(CFAA)。它指控 Perplexity 把 Comet 的身份伪装成了正常 Chrome 浏览器,属于「故意技术绕过」。

这个指控有一定道理。CFAA 当年是为了打击黑客入侵计算机系统设计的,条文里有一条禁止「超出授权范围访问计算机」。Amazon 的逻辑是:人类用户在 Amazon 上的授权是给真人用的,AI 用伪装身份进去,等于超出了授权范围。

Perplexity 的反驳很直接:你们真正的动机,是保护 560 亿美元的广告收入。

Amazon 的商业模式里,很大一块利润来自商家购买「赞助产品」位置——你在搜索结果里看到的「推荐」,有很大比例是商家花钱买的。AI Agent 没有眼球,不会被诱导性横幅广告吸引,它只会给出真正的最优解。对 Amazon 来说,AI「没有眼球」这个特性,直接动摇了它的广告系统。

有意思的是,法院第一次出手,站在了 Amazon 这一边。联邦地区法院的逻辑是:即便人类用户授权了 AI 替他购物,平台也有权基于「非人类访问」拒绝服务。这个判断的潜台词是:平台授权优先于用户授权——你想让 AI 进门,先问平台答不答应。

第九巡回法院的暂缓令把这个判断暂时搁置了,但没有否定这个逻辑,只是说「目前证据不足以维持禁令」。案子还会继续打下去。

但比这场官司的输赢更值得看的,是它背后暴露的真正问题:整个支付体系在设计之初,根本没有考虑过 AI 会成为付款方。

现在的支付这件事,是给人类设计的

以购物网站为代表的金融服务,都需要用户进行 KYC,比如上传护照扫描件,做人脸识别,有的还要线下打印文件签字后举着拍照。验证码要求你识别红绿灯和斑马线。信用卡结算要 T+1 到 T+7,还要收固定手续费——美国商户标准费率是每笔 2.9% 加 0.30 美元,国际卡再加 1%。

这套规则对人类消费者很友好。但 AI 作为付款方,这些全都驴唇不对马嘴——它的消费逻辑和人类完全不一样。

AI Agent 的交易特征,是高频、极微额、全天候的。每调用一次 API 收 0.0001 美元,阅读一行数据收 0.00001 美元,购买一秒 GPU 算力可能只花 0.000001 美元。你用传统信用卡结算,光手续费就把交易金额吃干净了。这不是优化一下体验就能解决的问题,是整套基础设施可能都需要来改动。

给 AI 建一套新架子

所以,2026 年的科技公司、金融机构和 Web3 开发者,正在重建一套给 AI 用的支付架构。按照红林律师我的理解,大致是三层。

第一层:身份

以前叫 KYC,了解你的客户。现在需要的是 KYA,了解你的 Agent。

KYA 协议要回答三个问题:这个 Agent 代表谁?它的单次支付限额和有效期是什么?它历史上有没有违约记录?

Skyfire 把 OAuth 授权和链上加密凭证结合了起来,给 AI 发一张「受权代理人」的数字护照。商户看到这张护照,就知道这笔交易背后有个真实的人类用户在承担责任,有问题能找到人。

F5 公司的云防御系统能识别携带 KYA 令牌的合法 AI 流量,把它和恶意爬虫区分开来。商户愿意把结算页面开放给这类 AI,因为知道它是「认证过的」,不是来偷数据的。

还有一个技术底座:TEE,可信执行环境。

TEE 的作用是给 AI 的私钥提供一个硬件级别的保险箱。主流方案是 Intel SGX 或 TDX,AI Agent 的核心逻辑运行在一个被物理隔离的加密舱里。

这个设计的直接目的是安全——即便云服务器被攻破,攻击者也看不到私钥,无法篡改支付决策。

但它解决的不只是安全问题。它让「授权不等于转让」这句话从法律概念变成了可验证的技术事实:用户给了 AI 花钱的权限,但 AI 只能在预设规则下调用签名,超出范围就签不出去。

第二层:协议

机器和机器之间,不应该模拟人类点网页。

HTTP 状态码 402,从 1999 年定义出来就没被用过。2025 年末,Coinbase 和 Cloudflare 把它激活了。

工作流程很简单:AI 向服务器请求数据,服务器说「这条数据收费 0.01USDC」,返回 402 状态码和收款地址;AI 钱包自动生成加密签名,附在请求头里发出去;服务器验证签名,资金通过 L2 网络实时结算,数据直接返回。全程不到一秒钟,没有跳转,没有弹窗,没有验证码。

Stripe 和 Visa 联合推出的 MPP 协议走得更远,支持「一次授权、多次支出」的会话模式:用户给 AI 开一个 24 小时有效的购物窗口,设定 200 美元上限,接下来 AI 在这个范围内的所有交易自动结算,不需要人类逐笔确认。Stripe 内部把它叫「金钱版的 OAuth」。

第三层:结算

在这个层面,稳定币是唯一的答案。

为什么不是银行转账?不是 PayPal?不是积分体系?

因为稳定币运行在区块链上,它是可编程的。银行转账是批量结算,今天汇出去的钱,对方可能要两天后才到账,中间有窗口期,有资金占压,有对手方风险。稳定币在网络上,结算时间可以达到毫秒级,没有窗口期,资金实时到账。

USDC 在 Base 链上单笔手续费不到 0.0001 美元,200 毫秒清算完毕。更重要的是,它支持「流支付」—— AI 每使用一秒 GPU 算力,就实时流转对应金额,完美按量计费。这对 AI 的商业场景来说是根本性的改变:AI 服务商可以按实际消耗收费,不需要预付,不需要锁定资金,不需要担心结算周期里的价格波动。

AI 的钱包也不是人类那种记助记词的钱包,而是高度定制化的智能合约,里面内嵌了三道安全阀:

-

白名单机制。资金只能流向经过 Skyfire KYA 认证的合法商户。未经认证的地址,一分钱都转不出去。这解决了 AI 被劫持后乱转账的风险。

-

幂等性保护。防止 Agent 因为逻辑死循环或者网络抖动,同一笔订单被重复扣款。一次确认,多次扣款,在传统支付里是个大麻烦,在智能合约里是可以从设计上避免的。

-

异常熔断。如果 Agent 在一分钟内发起的交易频率超过了预设阈值——比如正常场景下一分钟最多 10 笔,突然变成了 1000 笔——合约自动锁定,所有交易暂停,等人类来检查发生了什么。这不是可选项,是必须有的安全设计。

四个有待解决的法律问题

技术方案设计得好,不代表法律问题就自动消失了。

AI 手滑了,谁来赔?

如果 AI 误读了商品信息,把单价当成总价,下了一张 100 万美元的订单——这笔账算谁的?

按照现行代理法,如果商户有理由相信这个 AI 代表了用户的真实意图,契约责任通常由用户承担。但这个逻辑需要打补丁。

我们可以想到的解决思路是:对于超过用户日常消费均值 5 倍的订单,即便 AI 有完全授权,系统必须强制转回人类确认。这个机制叫「数字冷却期」。没有这个机制,法律上这类订单应该被视为可撤销的。

AI 的忠诚义务

如果 Perplexity 的 Agent 在搜索时,故意避开没有合作关系的低价平台,推荐的是给了佣金但价格更高的商品——这算不算违约?

AI 作为用户的代理人,在用户设定的约束条件下,应该寻求最优利益。如果服务商通过算法操纵 AI 的选择以谋私利,且没有向用户明确告知,用户有权根据《消费者权益保护法》和代理法起诉。

这不是理论风险。AI 的推荐算法天然容易被「竞价排名」污染,如果没有强制性的透明度要求,用户根本不知道自己的 Agent 是不是在给他挖坑。

AML 怎么穿透 AI 的交易?

AI 的高频微额支付,天然是洗钱的温床——每一笔金额太小、频率太高,传统风控模型根本盯不住。

解决方案在协议层。x402 的「促进者」(Facilitator)角色必须履行 KYT 职责,实时监测链上资金是否流向受制裁地址。每一笔稳定币变动,必须能溯源到背后真实的「碳基受益人」。

一旦 AI 系统被用于非法洗钱,不仅公司要面临监管处罚,相关责任人员也可能被追究个人责任。「人机共责」这个思路,简单说就是:写代码的人,不能躲在公司后面免责。算法工程师知道这段代码会被用来洗钱、还照常交付,和直接参与犯罪没有区别。这个逻辑在现行法律框架里不是没有依据——《刑法》里共同犯罪的规定,恰恰可以覆盖这种「明知故犯」的情形。

谁保管你的钱包?

AI 为了帮人类花钱,必须持有用户的支付凭证——私钥、平台登录权限、甚至生物识别令牌。

这个场景推进得比大多数人想象的要快。今天 AI 能帮用户买机票、订酒店、买跑步鞋,下一步就是交水电煤、还信用卡、管理日常开销。AI 持有的是用户的银行账号密码、支付密码,以及各大平台的登录权限。

这里有一个大多数人没想过的问题:你把凭证交给 AI,和你把权利交给 AI,是两回事。

举一个生活里的例子:你把银行卡交给子女方便急用,不等于授权他们可以随意支配你账户里的每一分钱。这里面有默认的边界,边界在哪里,双方心里都有数,只是没有明文写下来。AI 持有用户的支付凭证,道理是一样的——授权它帮你花钱,不等于授权它想怎么花就怎么花。但在法律上,这个边界目前是模糊的,没有判例说清楚,AI 在什么范围内有权替你花钱、超过什么范围必须经过你确认。

解决这个问题,两个层面需要同时推进。

法律层面。光靠用户协议写一句「受限授权」是不够的,这件事最终要由判例和立法来兜底。目前 AI Agent 的法律地位、责任边界、授权范围,在任何国家都没有系统性的规定。Amazon 和 Perplexity 的官司打下去,美国法院的判决会成为最早的参照系之一。在那之前,个案只能靠个案去趟。监管层面也是如此——现有的金融监管框架是给金融机构设计的,不是给 AI 服务商设计的,这条规则空白不会自己消失。

技术层面。光靠协议不够,还要靠代码来执行这个限制。TEE 硬件隔离是其中一种方案,但还有一个更大的方向值得重视:区块链。区块链的核心特性是去中心化存储——数据不集中在一个服务器上,而是分散在多个节点,任何单点被攻破都不会导致大规模泄露。把这个特性用到 AI 支付场景里,用户的支付凭证可以存在链上,而不是存在 AI 服务商的数据库里。AI 调取凭证时,私钥碎片在链上参与运算,但永远不会被完整提取出来暴露在内存里。这意味着即便是 AI 服务商本身,也无法单方面动用用户的资金。

技术层面和法律层面,在这个意义上是同一条路:都是在解决「谁来负责」的问题。法律靠追责体系,技术靠架构设计,两者最终指向同一个目标——让 AI 花出去的每一分钱,背后都有可追溯的责任人。

入口之后是什么

AI 和购物、AI 和支付之间那堵墙,迟早要被推倒,不是因为法院会判谁赢,而是因为趋势不会因为一份服务条款而逆转。

支付革命只是第一块多米诺骨牌。

当 AI 能替人类花钱,它就拿到了进入现实世界的通行证。接下来的场景不难想象:AI 帮你谈薪资、替你做投资决策、参与供应链结算、在虚拟世界里购置数字资产。这些事情一旦发生,现行的民事法律体系、金融监管框架、数据权属概念,都会面临重构压力。

这不是危言耸听。每一代互联网的底层变革,都会催生一套全新的法律问题。PC 时代有计算机犯罪,互联网时代有隐私侵权和平台责任,移动互联网时代有移动支付和金融科技监管——每一波浪潮里,法律人都不是旁观者,而是第一批冲进去搭规则的人。

Web3 和 AI 的结合,是下一代互联网的主线。而曼昆律所专注的,正是这个新世界里正在发生的法律问题:稳定币与加密支付的合规路径、AI Agent 的责任边界、智能合约的效力认定、Web3 项目的监管归属。这些问题不会等到监管文件出台才有意义——它们现在就在发生。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯