AI也需要休息:从Claude Code泄露看智能体的“睡眠”机制

2026年3月31日,Anthropic公司因一次意外操作,将Claude Code的51万行源代码泄露至公共npm仓库。短短几小时内,代码被镜像到GitHub,再也无法收回。这次泄露不仅让安全研究者和竞争对手获得了宝贵的信息,还引发了一场关于AI是否需要“睡觉”的讨论。

在所有未发布的功能中,一个名为autoDream的模块引起了广泛关注。这一功能是KAIROS系统的一部分——KAIROS是一个后台常驻系统,负责在用户工作时持续观察并记录每日日志。而autoDream则只在用户关闭电脑后启动,整理白天积累的记忆,清除矛盾信息,并将模糊的观察转化为确定的事实。

KAIROS与autoDream共同构成了一套完整的周期:前者负责清醒时的感知,后者则专注于“睡眠”中的整理。这种设计让人联想到人类大脑的工作方式,也引发了关于AI是否需要休息的思考。

永不停机的代价

过去几年,AI行业最热门的话题之一是Agent(智能体)的概念。这些智能体被设计为自主运行、永不停机,被认为是AI相对于人类的核心优势。然而,Anthropic却在其代码中为AI设置了“休息时间”。这背后的原因是什么?

每个大语言模型都有一个“上下文窗口”,即同一时刻能处理的信息总量存在物理上限。当Agent持续运行时,项目历史、用户偏好、对话记录等数据不断堆积,超过临界点后,模型开始遗忘早期指令、前后矛盾,甚至编造事实。技术社区将这一现象称为“上下文腐化”。

许多Agent的应对方案显得简单粗暴:将所有历史数据塞入上下文窗口,指望模型自行分清主次。然而,信息越多,表现越差。这与人类大脑面临的问题如出一辙。

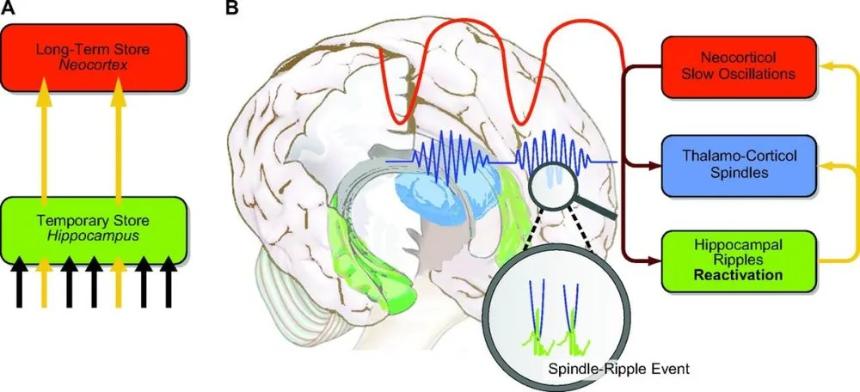

人类的大脑在白天经历的一切会被快速写入“海马体”,这是一个容量有限的临时存储区。真正的长期记忆则存放在“新皮层”,容量大但写入速度慢。睡眠的核心任务就是将满载的海马体清空,将有用的信息搬运到长期存储区。

瑞士苏黎世大学神经科学中心的比约恩·拉施(Björn Rasch)实验室将这一过程命名为“主动系统巩固”(active systems consolidation)。实验表明,持续剥夺睡眠会导致记忆力下降、注意力涣散,甚至基本判断力也会崩溃。

自然选择对低效行为极其残酷,但睡眠却没有被淘汰。从果蝇到鲸鱼,几乎所有有神经系统的动物都睡觉。海豚甚至演化出了左右脑轮流休息的“半脑睡眠”——它宁可发明一种全新的睡法,也不放弃睡眠本身。

趋同进化的启示

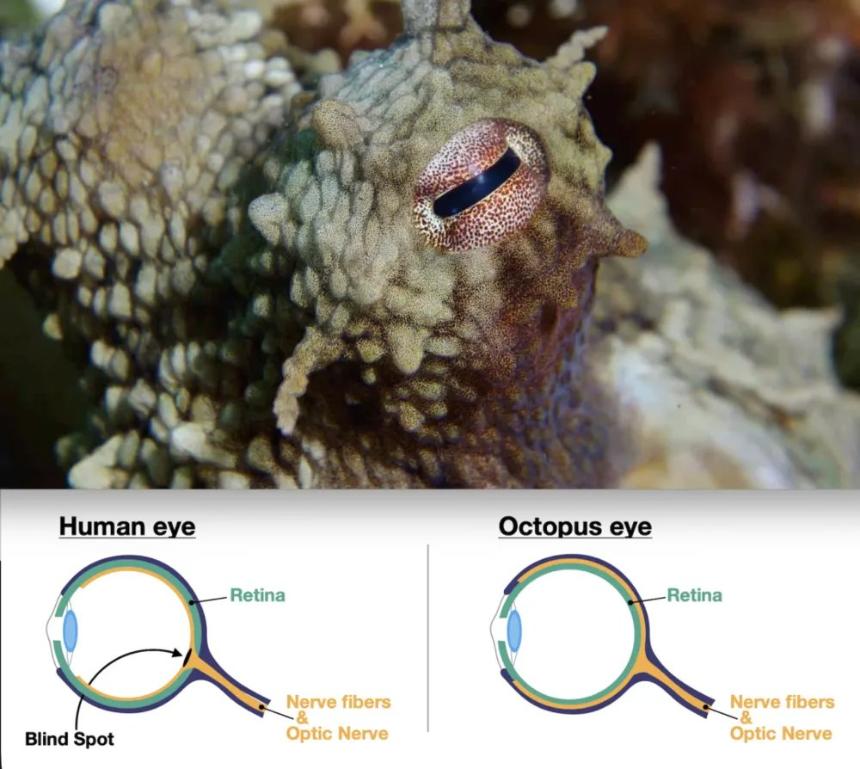

生物学中有一个概念叫“趋同进化”:亲缘关系很远的物种,因为面对相似的环境压力,会独立演化出相似的解决方案。例如,章鱼和人类的眼睛结构几乎相同,尽管它们的共同祖先生活在五亿多年前。

autoDream与人脑睡眠之间的关系可能正是如此。两者在相似的约束条件下,逐渐收敛到相似的结构。

首先,两者都需要离线运行。autoDream不能在用户工作时运行,它以分叉子进程的身份独立启动,与主线程完全隔离。人脑则更彻底:记忆从海马体搬到新皮层的过程依赖于一组只在睡眠中才会出现的脑电节律。

其次,两者都不做全量记忆,而是进行编辑。autoDream启动后不会保留所有日志,而是优先处理与此前认知有偏差的部分。人脑在睡眠中做的几乎是同一件事:优先巩固那些不寻常的信息,而丢弃大量重复的日常细节。

不过,两者也有不同之处。autoDream产出的记忆被明确标注为“hint”(线索),而非“truth”(真相)。每次使用前都需要重新验证其准确性。而人脑没有这套机制,这也是目击证人常常给出错误证词的原因。

更聪明的懒惰

在演化生物学中,趋同进化意味着两条独立的路线,在没有直接交换信息的情况下,走向了相同的终点。Anthropic的设计团队或许并非有意模仿人脑,而是因为撞上了同样的物理墙。

过去两年,AI行业对“更强的智能”的定义几乎总是指向同一个方向:更大的模型、更长的上下文、更快的推理、7×24小时不间断运行。然而,autoDream的存在暗示了一个不同的命题:聪明的智能体可能是更懒惰的。

一个从不停下来整理自己的智能体,不会变得越来越聪明,只会变得越来越混乱。正如人类大脑通过睡眠来理解世界一样,AI或许也需要类似的机制。

或许,一个从不睡觉的AI,不是更强的AI。它只是一个还没意识到自己需要睡觉的AI。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯