2026年第一季度:AI Agent的成年礼与行业变革

作者:博阳,腾讯科技 2026年3月6日,深圳腾讯大厦楼下,近千人排着长队,不是抢手机,是求人帮自己装一个软件。它的黄牛价一度炒到 1000 块。龙岗区和无锡高新区直接把这个软件写进了政府补贴文件。Sam Altman 坦言,面对自驾类似产品时,最初决定不让 AI 完全控制电脑的想法「只坚持了两个小时」。

这个软件叫 OpenClaw,是一个开源的 AI Agent(智能体)。

2026 年第一季度,它和另外四种完全不同的 Agent 产品形态在同一个窗口期同时冒了出来。OpenClaw 走个人助理、Cowork 走办公协作、Codex App 走长程工程任务、Perplexity Computer 走统一工作站、腾讯云 ADP 走企业平台。

五家公司各走各的路线,这不是巧合。巧合是一家公司碰巧做了个好产品。五家同时动手,只能说明一件事——某个底层条件刚刚成熟,大家同时闻到了味道。

在这一季度,我们关注的不是单点事件,而是结构性变化,即那些真正改变了游戏规则的东西。

筛选标准有四条。

第一,全行业共振。不是某家公司的单独行动,是多家同时往一个方向跑。五家公司同时推出 Agent 产品、几十个团队同时在搭约束框架、至少三条独立路线同时跑通了递归研发。

当所有人同时动手,那就不是谁有眼光的问题,是地基变了。

第二,因果咬合。不是碰巧撞在同一个季度的四件事,而是前一个直接催生了后一个,去掉任何一环,后面的都不成立。

第三,质变被感知。这说明这些趋势不是圈内的小幅进步,而是跨过了某个临界点,长足提升到了大众能感知的程度。深圳排队装 OpenClaw 上了社会新闻,「龙虾大战」成了大众话题,政府把 Agent 写进补贴文件,22% 的员工瞒着 IT 部门偷偷在用。当一个技术趋势溢出技术圈,进入公共讨论,它就不再是「行业动态」,而是时代转折的信号。

第四,认知不可逆。具体的产品会被替代,具体的框架会被迭代,但这些趋势背后的想法不会消失,比如「Agent 需要纪律约束」这个共识不会退回去,「经验应该可被 Agent 复用」这个方向不会退回去,「Agent 应该能改进自己」这个预期不会退回去。形态会变,认知不会。

符合这四条的,Q1 恰好有四个。

- 自动化的AI Agent进入产品化。Agent 终于能独立做事了,从分钟级演示跨入了天级执行。

- 约束工程。Agent 学会了守规矩,6 周内行业逼出了一整套纪律框架。

- 递归研发。Agent 开始自我成长,不只是执行任务,而是改进自己执行任务的方式。

- Skill生态。Agent 通过Skill这种模式开始继承了前人经验,人类的行业 know-how 第一次有了可被 Agent 直接复用的格式。

而且这四股力量并非并列,而是一个飞轮。

Agent 能独立做事后暴露了不守规矩的问题,倒逼出约束工程;约束工程给了纪律,递归研发才跑得起来;递归研发产生了对经验复用的刚需,催生了技能生态;技能生态反过来让 Agent 能处理更复杂的任务,飞轮转入下一圈。

Q1 是这个飞轮第一次完整转动的季度。

2026 年 4 月 10 日,腾讯新闻发布《AI 趋势研究白皮书 2026Q1》(以下简称「白皮书」)。这份长达 59 页的报告聚焦的正是整个飞轮的运作逻辑。

这篇文章,就是精简自白皮书的内容,沿着这四股力量,给出的 25 个具体判断。

长程Agent的产品化,是它的成年礼

Agent 过去像个才艺展示的孩子。叫它表演一段很惊艳,但你真不敢把事情交给它。以前的模型演示三步就技惊四座,走到第五步就彻底丧失全局视野,开始胡来。

Q1 这件事儿变了。变化的点不单纯是模型智商更高了,而是Agent 终于能做到「你去睡觉,它自己在那干活」。

Cursor Agent 单任务已经跑到 36 小时。Claude Code 单日最高提交了全球 4% 的公开 GitHub 代码,年化收入约 25 亿美元。Dario Amodei 确认 Claude 超过 90% 的新代码是 AI 自己写的。Anthropic 内部甚至有工程负责人说「我不再写任何代码了,我只让 Opus 做,我来编辑」。Anthropic 52 天内连发 74 次更新。Codex 周活跃用户突破 160 万,桌面应用下载超 100 万。

而在其中最耀眼的 OpenClaw GitHub 星数在 60 天内从 9K 飙到 247K,飙到 200 万月活。

除此之外,Karpathy 把驱动了 150 万 Agent 注册的 Moltbook 称为「近期最接近科幻起飞的现实」。OpenAI 情人节当天宣布收购 OpenClaw 创始人。

中国这边反应更猛。至少九家公司在同一季度推出桌面 Agent 产品,腾讯绑微信和企微,字节锚飞书和云端 SaaS,阿里从编码工具切入通用办公,百度靠搜索技能降低门槛。业内称之为「龙虾大战」——取名来自 OpenClaw 的 logo,一只龙虾,寓意 Agent 终于长出了能抓住东西的钳子。

Agent 确实能独立做事了。但为什么偏偏是现在?

- 破圈靠的不是能力,是可及性

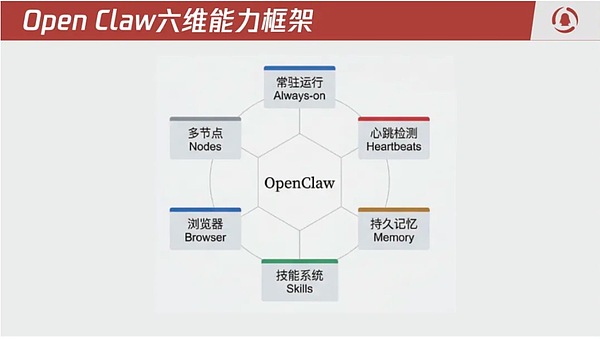

OpenClaw 的六个维度——持续在线、心跳机制、外化记忆、Skill(技能包)、浏览器接管、远程节点调用——没有一个是原创的。AutoGPT 和各类浏览器代理早就画过这张饼。但 OpenClaw 把它们焊在一起,产生了质变。

真正让它破圈的是两样更朴素的东西,IM(即时通讯)接入和 7×24 主动性。

Cowork 在能力层面几乎全面对标甚至超越 OpenClaw。Anthropic 的三层产品体系——Claude Code 命令行、Cowork 桌面应用、Computer Use(计算机操作)+ Dispatch(调度)跨设备遥控——从技术深度上看远比 OpenClaw 精密得多。Computer Use 在 OSWorld 基准上追平了人类水平(72.5% vs 人类 72.4%)。但它唯独缺了两样东西。

IM 让 Agent 在你最熟悉的界面里等你。7×24 让它不等你说话就自己醒来巡视。两个合在一起,Agent 不再等你开口,它主动来找你。OpenClaw 压根不跟用户解释什么是上下文窗口或检索增强,直接甩出一句大白话——「我会一直在线、我会记住你说的话、我会自己把事情做完」。先看疗效再讲原理,这套市井打法直接击穿了技术壁垒。22% 的员工在 IT 部门压根不知道的情况下就偷偷用上了 OpenClaw。

可及性压倒能力。技术深度并不如 Cowork 的 OpenClaw 拿走了用户心智,就因为它在对的界面、对的时间、以对的姿态出现在了用户面前。

- 五条分叉同时出现,OpenClaw 不是唯一

在与OpenClaw同期的自动化产品中,我们可以看到五条路线。

他们背后是两个条件同时到位。

第一,模型终于跨过了「可持续执行」的及格线。现在的模型依旧会犯错,但至少能在几十步的循环中勉力撑住,不会跑到一半突然忘了自己在干什么。这个差异是决定性的——局部犯错可以靠系统脚手架纠正,全局崩溃则无药可医。

第二,Harness(脚手架)工程方法论足够稳了。记忆从黑盒向量数据库变成了用户可以直接翻阅和编辑的纯文本文件,支持 Git 版本控制。执行环境有了网关、心跳机制、浏览器接管和远程节点调用。

能力加脚手架同时到位,长程 Agent 才成为全行业的共同选择。Codex App 的 Worktree 架构让多个 Agent 在同一代码仓库并行工作,5 个并行 Worktree 将 42 分钟的任务降至 14 分钟,合并冲突为零。Agent 的执行跨度正式从分钟级迈入天级。

- 编码之后,第二个刚需场景已经成立

OpenClaw 加上 Skill 市场,把 Agent 从开发者工具变成了通用工作助手,调研、监控、内容生成、客服,什么都能接。13,700 个 Skill 覆盖的场景远超编码。

这里的规律很清楚,只要有 Skill 把领域 know-how(行业经验)标准化,任何长程高认知工作都是 Agent 的菜。但短程低认知操作不是——点杯奶茶,你用手机 30 秒搞定,Agent 反而更慢。

- 围墙花园挡不住 Agent

在国内,九家大厂各绑各的 IM 抢入口。这场仗打的「Agent 应该长在哪个 App 里」,争的是生态入口权。但到了 Q1 末这堵墙就开始松了,QClaw 支持飞书和钉钉,OpenClaw-CN 内置五大 IM 适配。

因为当 Agent 需要同时帮你处理微信里的客户消息、飞书里的团队协作、钉钉里的审批流程,它就不可能只活在一个 IM 的笼子里。Agent 越刚需,跨平台压力越大,围墙花园越撑不住。现在比的是「谁离用户最近」,以后比的是「谁能让 Agent 在所有地方无缝干活」。

硅谷和中国的打法很不一样。硅谷围绕「模型供应商 vs 中间层」开打——谷歌 2 月中旬突然大规模封禁通过 OpenClaw 调用 Gemini 的用户,事先没有任何警告,数百个付费账户一夜关停。表面理由是「恶意使用导致计算负载远超预期」,实际上是 OpenClaw 的心跳机制每 30 分钟就带着数万 Token 的完整上下文检查一次,单个 Ultra 订阅用户的实际消耗折算成 API 价格可达 1000-3600 美元,远超 250 美元月费。这是对订阅制商业模型的直接冲击。

Anthropic 直接把这种行为定性为「Token 套利」,要求用户走 API 密钥接入(价格是订阅制的 5-10 倍),并最终在4月初直接封禁了Openclaw的订阅制入口。OpenAI 则选了相反的路,收购 OpenClaw 创始人,然后把它列入白名单。

说白了,当一个开源中间层能让用户绕过官方定价获取模型能力,平台就必须在封堵和收编之间做选择。

同一个 OpenClaw,在硅谷催生了一场定价辩论,在中国催生了一场入口战争。

- 第一层替代潮,落在了外包服务上

红杉的 Julien Bek 算了一笔账,企业每花 1 美元买软件,就要花 6 美元买服务。会计、法律、IT 托管、招聘、保险经纪,全是服务。Agent 的计价单位正在从 seat(按人头)和 feature(按功能)转向 workflow(按流程)和 outcome(按结果),但真正好切的口子不是替人,是替外包合同。

想想看,一项工作已经被外包了,说明公司本来就接受外部执行、有现成的预算线、买的就是结果。替换外包等于换个供应商,替换内部员工等于组织调整,前者的阻力小一个数量级。

这就解释了为什么 Harvey(法律)、Anterior(医疗审批)、WithCoverage(保险)这类垂直 autopilot(自动驾驶式 Agent)起量比通用 Agent 快得多——它们瞄的不是「AI 替人」这个政治雷区,而是「AI 替外包」这个商业自然区。对照 OpenClaw 也能印证,个人用户让 Agent 代跑的第一批任务,恰好是以前花钱请虚拟助理干的那些活儿,比如监控、调研、社媒管理。6 倍于软件的服务市场,才是 autopilot 真正的地基。

- 技术能力已经跑到了组织接口前面

Block(Square + Cash App 的母公司)展示了一个极端形态,公司直接重构为四层智能体架构,中层管理取消,产品路线图由智能层的 failure signal(失败信号)自动生成,不再有产品经理拍板做什么功能。但 Block 的前提是双边交易平台的高频结构化数据,大多数公司不具备。

真正卡住 Agent 从 copilot(副驾驶)走向 autopilot(自动驾驶)的,不是模型能力,而是三个各自有独立节奏的组织接口,包括evaluation 体系(怎么判断 Agent 干得达不达标,会计有 GAAP 标准,但法律建议和招聘筛选的评判标准远没成型)、授权边界(谁允许它执行、执行边界写在 system prompt 里还是写在业务规则系统里)、责任归属(出了错谁兜底,copilot 模式下有人签字,autopilot 模式下系统背后既没有职业资质也没有职业保险)。

模型能力是算力和资本的函数,砸钱就能涨。这三样东西是时间和制度的函数,不会因为模型变强就自动跟上。从 copilot 到 autopilot 中间,大概率存在一个被严重低估的过渡形态——AI 在明确边界内自主执行,边界由业务规则而非 prompt 定义,碰到异常自动 escalate(升级)给人类。这比纯 autopilot 离钱更近,也比纯 copilot 更有价值。

能独立做事是飞轮的起点。但 Agent 一上路就暴露了致命短板。OpenClaw 的 512 个安全漏洞、341 个恶意 Skill、动辄几百上千美元的账单都是明显的坑。

独立能力带来了新问题,新问题倒逼出了飞轮的第二股力量。

约束工程,让Agent 学会了守规矩

Agent 能独立做事之后暴露的头号问题,就是它不守规矩。记忆像金鱼,做三步就宣布大功告成,自己给自己打高分但端到端根本跑不通。

Q1 用 15周时间硬生生逼出了一套解法。从 Anthropic在25 年 12 月 5 日发布第一篇Harness的博客到 LangChain 3 月 10 日泛化定义,Harness Engineering(约束工程)就完成了行业共识。

这个速度本身就说明大家有多急。因为 Agent 已经上路了,规矩还没立好。

- 从「看什么」到「怎么持续做对」

Context Engineering(上下文工程)管的是信息层,即「该让模型看到什么」。Harness Engineering 管的是结构层,即「模型在几十轮里怎么持续把事做对」。

后者是 Q1 真正的范式跳跃。

Claude Code 每天在 GitHub 上产生 13.5 万到 32.6 万次公开提交,占全球公开提交的 4%,预计年底达 20%。Agent 在代码仓库里已经跑得这么深了,不配一套专门的纪律约束,迟早出事。

腾讯高级执行副总裁汤道生在 3 月 27 日的上海峰会上给了中国版定调:「AI 落地不只是算法题,更是一道工程题。随着主流大模型能力差距缩小,企业竞争核心不再是模型本身的强弱,而是通过工程化手段发挥模型价值的能力。」

其他大厂也纷纷入局,字节的DeerFlow 2.0 在 GitHub 描述里直接写了「Super Agent Harness」,很可能是中国开源项目第一次在产品定位里用这个词。它在一个月内在Github上从 22K 飙到 52K 星,大家求Harness若渴之情尽在其中。

- Harness 是三层壳

想讲明白Harness,我们可以把 Agent 想象成一辆车。模型是引擎,Prompt(提示词)是方向盘。但光有引擎和方向盘不叫车,你还得装变速箱、仪表盘和刹车。Harness就是这些部件,目前的工程实践上,总共有三层。

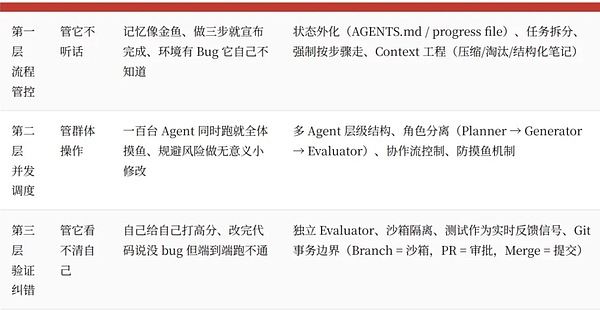

第一层,流程管控,专治不听话。记忆像金鱼、做三步就宣布完成、环境出了 Bug 自己浑然不知。治法是状态外化(AGENTS.md / 进度文件)、任务拆分、强制按步骤走。

第二层,并发调度,专治群体摸鱼。一百台 Agent 同时跑,很容易全体规避风险、专挑最简单的小修改做,真正的难题没人碰。治法是多 Agent 层级结构、角色分离(Planner 规划 → Generator 生成 → Evaluator 评估)、防摸鱼机制。

第三层,验证纠错,专治迷之自信。自己给自己打高分,Anthropic 管这叫「self-deception」(自我欺骗)。治法是独立 Evaluator、沙箱隔离、Git 事务边界(Branch 是沙箱、PR 是审批、Merge 才算提交)。

CLI、Skill、外化记忆格式等这些常被提到的,在第一季度也成为开发领域的趋势在工程实践上其实不能完全算 Harness,是 Agentic Infra(Agent 基础设施)。Harness 只管「车怎么开能稳定」,Infra 管能提速、快捷的「路况和加油站」。

- 每一层壳都是被 bug 逼出来的

Harness并非凭空出现,而是来自于一系列工程实践中遇到的具体问题。当人们想要让模型执行更长程的任务时,一次次bug逼出了它。

第一层的来历。

用户把大需求一次性丢给 Agent,它试图一口气全做完,在第 30 步崩溃。Anthropic 想出的解法很朴素,像一场接力赛——「初始化 Agent」搭好环境写一份交接清单(claude-progress.txt),然后退场。「编码 Agent」每次上场先读交接清单,搞清楚上一棒做到哪了,只做一个功能,做完更新清单再退场。要点是 Agent 之间不共享对话历史,只通过文件传信息。因为对话历史到第十轮时已经被前九轮的噪音彻底淹没了。

第二层的来历。

Cursor 发现 Agent 在扁平结构下极度规避风险,宁愿做无意义小修改也不碰难题,整个系统空转。Anthropic 引入了「甲方乙方」架构——Planner 写规格书,Generator 按规格书逐个功能实现,每个功能开工前先写一份 Sprint 合同。Evaluator 用真实浏览器(不是看代码)测试功能,按产品深度、功能性、视觉设计、代码质量四个维度打分,不达标就冲刺失败,必须返工。一个有意思的发现是,单独把「打分的人」调严格,比让「写代码的人」学会自我批评容易得多。

第三层的来历。

Agent 自己跑自己写的测试说「没 bug」但端到端根本跑不通。Anthropic 管这叫「self-deception」——跟让学生自己给自己的作文打分一个道理,分数永远不会低。必须有独立的 Evaluator 和沙箱隔离。

Mitchell Hashimoto 在开源项目 Ghostty 里的 AGENTS.md 根本不是什么设计文档,就是一本事故档案——Agent 动了不该动的文件,就加一条「不要修改 vendor/ 目录」。Agent 用了过时的接口,就加一条「使用 v2 API 而不是 v1」。Agent 在 commit 信息里瞎写,就加一条格式规范。他发现正常工作日只有 10-20% 的时间能有效运行后台 Agent,刚开始「花的时间比自己手动干还长」。但一旦过了拐点,规则累积到一定密度,Agent 犯错率就明显下来了。

OpenAI 发现了一个更慢性的病,没有专门的维护机制,Agent 用过的仓库大约 2-3 个月后就会明显变差。就像每天有十个实习生进来干活,走的时候都留下一堆「临时解决方案」,三个月后没人分得清哪些代码是认真写的哪些是凑合的。他们搭了三个机制——架构约束声明(在 AGENTS.md 中明确写出项目用什么框架什么模式什么命名规范)、Doc gardening(定期清理 Agent 留下的过期注释和冗余文档)、Anti-slop routine(反劣化巡检,清理 Agent 累积的风格不一致和重复代码)。不是一次搞好就行,得持续跑。

- 换壳比换模型更划算,但不便宜

LangChain 做了个实验,同一个模型,换一套 Harness,Terminal Bench 2.0 通过率从 52.8% 拉到 66.5%,权重一个字节没动,排名从三十名开外飙到前五。

这就是Harness的效果。

但这个效果很贵。

Anthropic 的成本数据显示,Solo Agent 裸跑同一个 2D 游戏,只用花 9 美元、用 20 分钟,但做出来的东西主要功能损坏,根本没法玩。套上完整 Harness,花 200 美元、用 6 小时,成品功能完整、视觉精良,可以正常游玩。

20 倍成本换来的不是「好了一点」,而是「能用和不能用」的生死之别。

从这一点看,Harness 是目前性价比最高的能力放大器。但它真不便宜,它和维持一个持续运行、懂规矩的 Agent 和偶尔问一嘴的聊天助手,完全不是一个量级。

动辄几百上千美元的账单让很多用户体验几周后就被直接劝退了。成本依然是普及路上最大的绊脚石。

- Harness 是暂时的护城河,但补偿面在迁移

全行业都在拼命砌Harness的砖的时候,Anthropic 已经在砸自己建的这层壳了。

Opus 4.6 发布后,他们拆掉了 Context Reset,因为模型的上下文管理能力已经强到不需要重置上下文了。拆掉了 Sprint Contract,因为新模型能自己把控节奏,不需要每轮开工前先签一份验收合同。Evaluator 也从每轮对抗改成了最后一轮做 QA。

按Anthropic自己的话说,「Harness 的每一个组件都编码了一条关于模型做不到什么的假设。当假设不再成立,组件就该走了。」

能拆说明当初搭得有效。拆得果断说明他们一直清楚自己在补偿什么。

难的不是拆,是判断什么时候该拆。拆早了模型还撑不住,系统会塌;拆晚了壳遮住模型的真实能力。

当模型进化时,你以为壳在帮忙,其实壳在碍事。

通往简单的路必须经过复杂。但目前完成了从「加」到「拆」完整周期的,只有Anthropic一家。

- Harness 之外还有更大的壳

Q1 热议的五个共识点,Markdown 做状态载体、Git 做事务边界、CLI 文艺复兴(Agent 需要结构化的文本界面,一条 git diff --stat 就能拿到整个变更概览)、测试实时化(Agent 改一个文件立刻跑测试,测试结果变成每一步的即时反馈信号)、Skill 做知识封装,其实并不全属于 Harness。

更大的框架叫 Agentic Infra(Agent 基础设施),分五层——Context 层(Agent 能记住什么)/ 工具接口层(Agent 能做什么)/ Harness 层(Agent 怎么被管住)/ 知识层(Agent 知道怎么做)/ 经济性层(跑 Agent 花多少钱)。

Harness 是最核心的一层,但远不是全部。眼下行业注意力集中在 Harness 层,因为它直接决定了 Agent 能不能用。但下一阶段的仗可能在别的层开打——Context 层的记忆质量(跨天、跨会话的记忆保持还很不靠谱)、工具接口层的执行环境资源(Anthropic 发现光是放宽资源限制就能提升 6 个百分点的成功率)、知识层的 Skill 触发机制(Vercel 评测显示 56% 的情况 Agent 根本不会主动去查自己有的 Skill)、经济性层的成本控制(模型路由、预算分配、并行化策略到目前为止基本还是拍脑袋)。

还有一个所有人都心知肚明但没人有好答案的问题——组织级治理。「这段代码是谁批准 Agent 写的?」在大多数企业里没有标准答案。审计日志、决策溯源、代码所有权归属。3 人创业团队可能靠工作流层的审批关卡就凑合了。但在 500 人的企业里,没有独立的治理框架,光靠技术手段根本落不下去。

这是 Harness 架构里不负责,但是Agent真正能让人放心的、至关重要的部分。

- Agent 失败终于可以被诊断了

三层壳 + 五层 Infra 给了行业第一套诊断框架。Agent 崩了不再只能甩一句「模型不够好」了。

到底是流程管控没做好?并发调度失控了?验证环节缺失了?还是执行环境资源不够、Skill 没触发、成本根本划不来?

过去统统归为「模型能力不足」的玄学问题,现在终于有了精确的工程归因。「Agent 为什么崩了」从一句模糊的抱怨变成了可定位、可修复的工程问题。

约束工程给了 Agent 纪律,飞轮可以转入下一圈了。

递归研发,让Agent开始自己变强

前面两章讲的是 Agent 作为产品和系统怎么站住脚的。这一章讲的是,当 Agent 有了纪律之后,它在哪个场景里最先突破了「执行者」的角色,开始改进自己执行的方式。

答案是研发。因为研发天然可验证(测试通过就是通过)、可回退(Git 一键撤销)、可读写(代码本身就是机器能直接操作的纯文本)。

三个条件凑齐,Agent 就能进入「执行 → 验证 → 发现问题 → 修改 → 再执行」的完整循环。

- 探索、优化、工程流是三种完全不同的递归

现在我们来详细看看这三类方法。

探索型,AlphaEvolve。

它不是在调参数,是在搜索人类压根没见过的新算法。由 Gemini Flash(负责广度,快速生成大量变体)和 Gemini Pro(负责深度,精雕细琢最优方案)组成的进化系统。整个过程产出的是人类可读的代码,不是黑箱——看得懂、调得了、直接能部署。它发现的数据中心调度算法已经在 Google 生产环境里跑了一年,持续回收全球 0.7% 的算力,换算成钱是数十亿美元级别。它给 TPU 关键电路提了优化方案,把 Gemini 架构中一个关键计算内核的速度提高了 23%,把 FlashAttention 的底层指令优化了 32.5%。在 50 多个数学

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯