DeepSeek V4:万亿参数AI模型的全面解析与行业影响

来源:DeepSeek官网,编译:金色财经

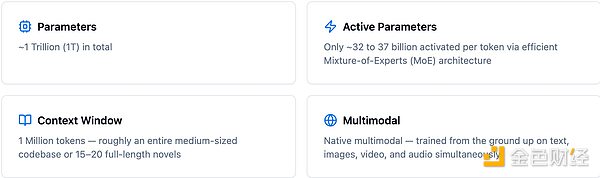

人工智能领域正迎来一场重大变革。DeepSeek V4 是 DeepSeek 即将推出的旗舰模型,它不仅突破了参数量级的边界,还实现了前所未有的高效性能。该模型预计拥有 1 万亿(1T)参数,原生支持多模态,并配备 100 万 token 上下文窗口,直接对标 OpenAI 的 GPT-5.4、Anthropic 的 Claude Opus 4.5 等西方科技巨头产品。

在这篇全面解析文章中,我们将深入解读 DeepSeek V4 的核心规格、架构创新、预计定价,以及其背后的战略级硬件布局转变。

核心要点

- 采用 MoE 架构,万亿参数规模,但处理每个 Token 时仅激活约 320 亿~370 亿参数。

- 100 万 Token 上下文窗口,相当于 15~20 部长篇小说的文本量。

- 原生多模态能力:从底层支持文本、图像、视频与音频处理。

- API 定价仅为 GPT-5.4 与 Claude Opus 4.5 的 1/10~1/50。

- 模型权重预计以 Apache 2.0 开源协议开源。

- 可本地部署运行:双路 RTX 4090 显卡或单张 RTX 5090 显卡即可支持。

DeepSeek V4 是什么?

DeepSeek V4 在前代产品(如 V3 和 R1)的成功基础上,将超大规模扩展能力与极致运行成本效率相结合。以下是其主要技术参数:

三大突破性架构创新

DeepSeek V4 的真正实力不仅在于强大的算力,更在于三项具体的架构突破,让万亿参数模型的训练与运行成为可能且成本可控。

1. Engram Conditional Memory

百万 Token 上下文窗口面临的最大难题,是在计算成本不急剧飙升的前提下精准检索信息。DeepSeek 通过 Engram 架构解决了这一问题。该系统将静态事实(如 API 签名或特定模式)与动态推理分离开来。

在 “Needle-in-a-Haystack” 基准测试(在 100 万 Token 中查找特定事实)中,Engram 使准确率从常规的 84.2% 大幅提升至惊人的 97%。

2. 流形约束超连接结构(mHC)

随着 AI 模型规模不断扩大,模型往往会出现训练不稳定问题(例如梯度爆炸)。流形约束超连接结构(mHC)是一套数学框架,能够对信号放大幅度进行约束,将其控制在 2 倍以内(相比之下,无约束状态下可达 3000 倍)。

这使得 DeepSeek 能够以仅 6.7% 的计算成本,稳定完成万亿参数模型的训练。

3. DeepSeek DSA 机制与闪电索引器

为高效处理 100 万 Token 上下文,V4 采用稀疏注意力机制(DSA)替代了传统的密集注意力。闪电索引器可快速扫描上下文并定位相关片段,模型仅需对这些特定令牌集中执行注意力计算。

在长上下文场景下,该方案可将计算成本降低约 50%。

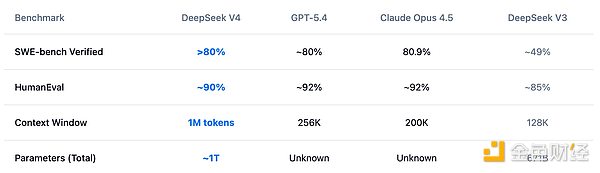

基准测试对比:DeepSeek V4 vs GPT-5.4 与 Claude 4.5

DeepSeek V4 重点聚焦于软件工程与深度推理能力。据内部基准测试数据显示,该模型展现出了极为出色的性能表现。

注:这些数据目前均基于泄露的内部资料,待模型正式发布后还需等待独立第三方的验证。

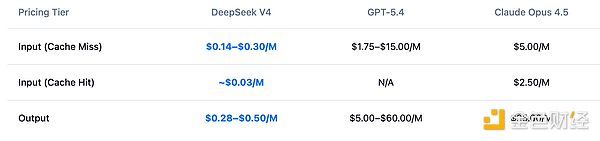

API 定价:最高性价比的前沿 AI

GPT-5.4、Claude Opus 等西方模型性能强劲,但使用成本高昂。例如,GPT-5.2/5.4 每百万输入 Token 的费用约为 1.75~15.00 美元,Claude Opus 4.5 为每百万 5.00 美元。而 DeepSeek V4 预计的 API 定价极具颠覆性:

这使得在性能相当的情况下,DeepSeek V4 的成本大约是其西方竞品的 1/10 到 1/50。

地缘政治与硬件:转向华为生态

DeepSeek V4 最具深远影响的特点之一,在于其硬件支撑体系。由于美国对英伟达高端 GPU(如 B300、H200)实施严格出口管制,DeepSeek 已对 V4 进行深度优化,使其推理环节主要依托中国国产芯片运行。

尽管模型的初期训练阶段大概率仍使用了英伟达硬件(如 H800),但该模型已针对华为昇腾 950PR 与寒武纪 MLU 芯片做了高度适配优化。

据报道,华为昇腾 950PR 的计算性能达到英伟达 H20(目前合法允许对华出口的芯片)的 2.87 倍。这标志着中国在实现人工智能芯片自主可控道路上的一个重要里程碑。

发布时间:DeepSeek V4 何时推出?

DeepSeek V4 经历了数次延期。最初有传闻称在 2026 年 2 月中旬农历新年期间发布,但由于在全新硬件架构上进行训练面临巨大的工程技术难题,发布时间被推迟。

2026 年 3 月 9 日,一个尚未正式公布的 “V4 Lite” 版本(约 2000 亿参数)出现在 DeepSeek 平台上,这实际上验证了其核心架构的可行性。

目前普遍预计,完整的万亿参数版本将于 2026 年 4 月正式发布。

发布后,DeepSeek 预计将采用 Apache 2.0 开源协议开放模型权重。得益于 MoE 架构的高效性和量化技术(INT8/INT4),这款超大规模模型有望在消费级硬件上本地运行,例如双路 RTX 4090 显卡或单张 RTX 5090 显卡。

DeepSeek V4 常见问题解答

1. DeepSeek V4 比 ChatGPT(GPT-5.4)更优秀吗?

根据内部基准测试结果,在复杂软件工程任务(SWE-bench)与代码库级编程任务中,DeepSeek V4 的表现可与 GPT-5.4、Claude 4.5 匹敌,甚至略占优势,尤其是在其百万 Token 上下文窗口的加持下。不过,该模型正式发布后,仍需通过独立测试才能判定绝对的优胜者。

2. 我可以本地运行 DeepSeek V4 吗?

可以,前提是按计划开源模型权重。由于 MoE 架构每次仅激活约 320 亿参数,量化版(INT4)理论上可在单张 32GB 显存的 RTX 5090,或双路 RTX 4090 显卡上本地运行。

3. DeepSeek V4 为什么成本这么低?

其低成本源于高效的 MoE 架构(仅激活模型的一部分参数)、低廉的训练成本(预估约 1000 万美元,而西方同类模型超过 1 亿美元),以及 DeepSeek DSA 机制的应用——该技术将长上下文所需的算力减少了一半。

4. V4 所谓的 “原生多模态” 意味着什么?

与早期模型将视觉插件 “拼接” 在文本模型上的 “后期融合” 方式不同,V4 从训练之初就同时基于文本、图像、视频和音频进行联合训练。这使其具备更出色的跨模态推理能力,例如通过分析手绘架构图,直接无缝生成对应的界面代码。

结论

DeepSeek V4 不只是一次增量更新,更是一项架构层面的突破。它证明了通过智能优化(Engram 内存架构、mHC 超连接结构、DSA 机制),完全可以与高成本、暴力堆参数的扩维方式相抗衡。

凭借原生多模态能力、百万 Token 上下文窗口以及颠覆性的定价策略,DeepSeek 正迫使企业与独立开发者重新审视自身的人工智能基础设施。一旦 API 与开源权重按计划于 2026 年 4 月推出,人工智能开发的整体格局或将迎来根本性变革。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯