AI算力产业链瓶颈传导的底层逻辑:从GPU到电力/液冷的系统性挑战

作者:qinbafrank;来源:X,@qinbafrank

近期,多家投行包括大摩、摩根大通、美银、高盛、瑞银、花旗、伯恩斯坦和HSBC发布了关于AI、半导体、电力及存储领域的更新报告。报告显示,AI硬件的瓶颈已从单一的“GPU供应”问题扩散至电力、芯片、存储、设备和材料五个维度的全面紧张。AI需求的增长已经突破了传统电力规划、半导体设备产能、存储价格模型以及机器人装机假设的所有预测区间。

大摩的全球主题研究复盘指出,全球每周大语言模型token消耗量在3个月内从6.4万亿个飙升至22.7万亿个,增幅达到2.5倍。美国2025-2028年数据中心电力缺口预计为55吉瓦;摩根大通的数据中心高性能计算项目债首次覆盖直接给出了“未来5年122吉瓦待融资”的缺口数字。美国5年电力规划从101吉瓦飙升至230吉瓦,其中44%的新项目并网等待时间超过4年。美银在给Alphabet的最新目标价报告中指出,2026年资本支出被上修至1815亿美元,同比翻倍,而自由现金流同比下降62%。这三组数据并非来自同一框架输出,而是三家独立机构在不同研究路径上的独立画像。

半导体产业链(尤其是AI算力领域)的瓶颈演变,正按照“计算(GPU)→存储(HBM等)→光互连→电力/液冷”这一清晰的顺序递进。这是2025-2026年的行业共识。随着AI训练/推理集群从单机柜(几十张GPU)向超大规模(数千至数十万张GPU)扩展,每解决一个环节的瓶颈,下一个物理/供应链限制就会立即暴露出来,形成“Leontief式”互补约束(缺一个都无法出货)。

有必要了解为什么会出现这种演变、当前现状以及背后的物理/工程原因:

第一阶段瓶颈:GPU计算(2022-2024年主导)核心限制

高端GPU(如NVIDIA Hopper H100 → Blackwell B200 → Rubin)本身的晶圆产能 + 先进封装成为主要瓶颈。AI大模型需要海量并行计算,TSMC 4nm/3nm/2nm逻辑工艺 + CoWoS(2.5D/3D封装)产能一度成为最大卡点。即使前端晶圆足够,后端将逻辑芯片与HBM堆叠封装的能力跟不上,整张GPU就无法交付。

缓解情况:TSMC大力扩产CoWoS(2024-2025年产能翻倍),NVIDIA Blackwell已实现大规模出货。但这只是“计算”环节解锁,随后立刻暴露新问题。

第二阶段瓶颈:存储(HBM高带宽内存,2024-2025年成为最紧缺)

核心限制:HBM3/HBM3e/HBM4产能。

为什么接力成为瓶颈:GPU算力提升后,模型参数爆炸式增长(万亿甚至十万亿参数),数据搬运(memory bandwidth)成了“内存墙”。HBM每秒可传输数TB数据,比常规DDR内存快20倍以上。由于HBM紧邻逻辑芯片,数据无需传输太远,因此节省了能耗。一张B200 GPU需要192GB+ HBM3e,单机柜(NVL72)HBM总量已达30-40TB,且带宽需求远超传统DRAM。

供应链现状:仅SK海力士、三星、美光三家能规模化生产HBM,工艺复杂(硅通孔TSV + 堆叠)。2025年HBM产能已全部售罄,2026年仍供不应求,价格同比暴涨246%。即使GPU芯片ready,没有HBM就无法组装交付,导致整个AI集群部署延期。

结果:存储从“商品”变成战略级卡脖子环节,资本开支中存储占比可达30%。

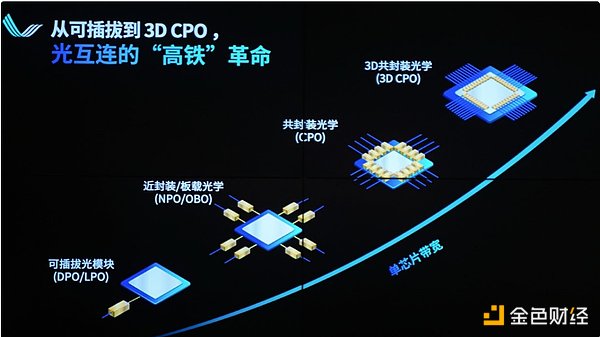

第三阶段瓶颈:光互连(2025-2026年正在切换)

核心限制:铜缆(NVLink/NVSwitch)在带宽、距离、功耗、重量上的物理极限。

为什么必然转向光:单机柜内(72张GPU)还能靠铜缆,但要扩展到多机柜、乃至数千张GPU互联时,铜缆衰减严重(1.8TB/s带宽下有效距离<1米)、重量爆炸(NVL72机柜铜缆超5,000根、总重1.36吨)、功耗高(可插拔光模块替代铜缆会额外吃2万瓦)。信号完整性、延迟、散热都无法支撑更大集群。

解决方案:转向光互连(CPO共封装光学 + 硅光子技术)。把光引擎直接封装在GPU/ASIC旁边,用光纤实现Scale-Out,带宽密度更高、每比特功耗更低、距离更远。

NVIDIA在2026年GTC大会大力押注,已投资光学公司,800G/1.6T光模块需求爆发式增长。Lumentum、Broadcom、Coherent、Ayar Labs等成为新赢家。

当前进度:铜缆已到极限,光互连正从“可选”变成“必选项”,正突破AI数据中心性能天花板。

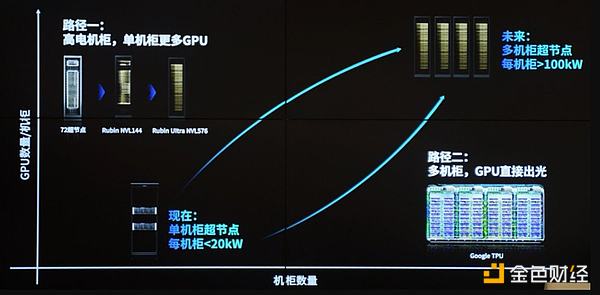

第四阶段瓶颈(当前最前沿):电力 + 液冷(2026年起成为最终物理约束)

核心限制:功耗墙 + 散热墙 + 电网接入。

为什么是终极瓶颈:每张GPU从300W→700-1200W,单机柜从10-20kW(CPU时代)飙升到120-200kW+甚至更高。传统风冷物理上限只有20-50kW,噪音、风量、能耗都不可接受。

电力侧:数据中心需GW级供电,电网并网排队可达数年,变压器、固态变压器等设备交付周期拉长至100周。微软CEO曾直言“有GPU但没电插”。

液冷侧:必须切换到Direct-to-Chip(直接芯片液冷)或浸没式液冷,结合微流控、冷板等技术。台积电已在CoWoS平台演示硅基液冷,支持>2.6kW TDP。Vertiv(VRT)等液冷/热管理厂商成为基础设施新核心。

连锁反应:PUE(电能利用效率)要求<1.2,余热回收、核电/新型能源并网都成为新话题。即使前面所有环节都解决,没有电和冷,机柜也无法上架运行。

AI算力产业链瓶颈转移的本质逻辑在于,AI算力不是“单点”问题,而是系统级Leontief生产函数——GPU、HBM、互连、电力、冷却必须按最低短板匹配。Hyperscaler(谷歌、微软、Meta等)每解决一个瓶颈,就立刻将资本和创新推向下一个环节。

目前(2026年)正处于“光互连加速落地 + 电力/液冷大规模商用”的切换期,未来可能还会出现新瓶颈(如激光器、光纤材料或电网变压器),但这个“计算→存储→光→电/冷”的链条已成行业公认路径。这也解释了为什么投资逻辑从NVIDIA/TSMC转向HBM三巨头(SK海力士等)、光学厂商(Lumentum、Coherent)、液冷/电力基础设施(Vertiv、相关电源公司)。每一次瓶颈转移,都在重塑整个半导体+数据中心产业链的价值分配。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯