Anthropic发布Opus 4.7:隐藏的八大变革性功能解析

作者:硅谷Alan Walker

发布会把聚光灯打在SWE-bench上,但真正的信号藏在脚注、引言块和一句不起眼的auto mode里。Palo Alto的California Ave上,早晨九点半那种光,斜着从Coupa Café的玻璃窗扫进来,照在Alan Walker半杯凉掉的flat white上。他刚刷完Anthropic的官网,往椅背上一靠,对着对面刚坐下的Tony开口。

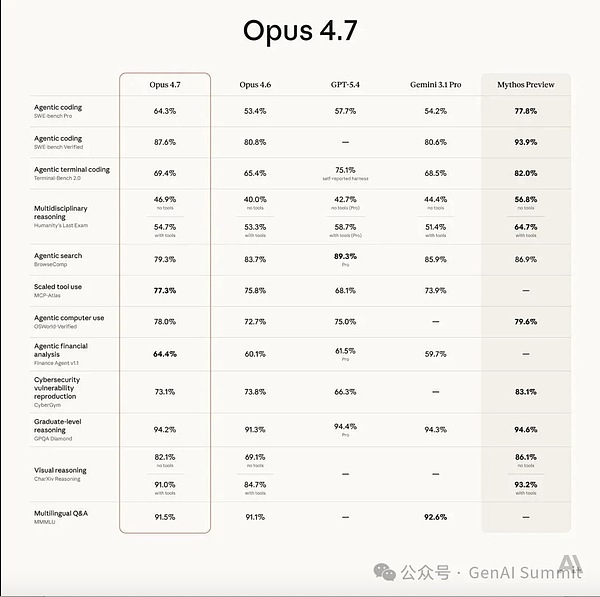

"Anthropic这次发布Opus 4.7,发布会搞得挺克制——主角是SWE-bench那几根柱子、客户quote轮播、一张漂亮的alignment图。大部分科技媒体抄完新闻稿就走了。"

"但这玩意儿真正的东西,都埋在脚注、migration guide、和一句'auto mode扩展到Max用户'那种轻描淡写的地方。你得像读10-K似的去读它——主文是给散户看的,附注才是给机构看的。"

"今天这杯咖啡喝完之前,我拆八把刀。每一把我都告诉你它砍向谁。"

xhigh不是档位升级——Default被偷偷拉高了

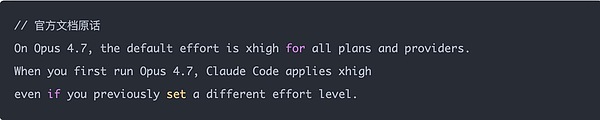

发布会一笔带过:"In Claude Code, we've raised the default effort level to xhigh for all plans."

大部分人看到xhigh以为是"又多了一个档",跟iPhone多一个颜色似的。错。真正的信号是最后半句——Claude Code里所有plan的默认档位被拉到xhigh。

这是一个非常Anthropic的动作:悄悄地,把所有人的基线拉高一档,然后算力账单不变。等于给你塞了一个更聪明的同事,但不涨工资。

TONY: 等等,这不就意味着原来Pro用户花$20拿medium,现在直接吃到xhigh?

ALAN: 对。而且Hex那段quote你仔细读——"low-effort 4.7 ≈ medium-effort 4.6"。叠加默认档拉高,等于普通用户拿到的有效智能,跳了整整两档。

发布会没有大写这个数字,因为他们不想让token消耗那页不好看。

◆ 落地场景

周一早上你让Claude Code改一个五百行的后端模块——原来你得手动敲/effort max才敢让它自己跑;现在你什么都不配,默认就是xhigh,一杯咖啡回来活儿干完。这个区别不是10%快,是"你不需要管它了"。

KILL LIST → "AI调优/prompt配置"类SaaS——那些教你怎么调thinking budget、怎么选effort的工具,默认值自动对了,中间层没生意

→ 初级工程师岗位——xhigh默认干的活,已经是三年经验工程师的质量下限

→ 外包code review公司——下面第三把刀会把这个按死

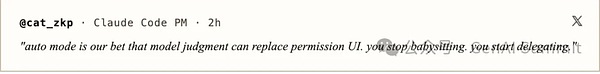

—— BLADE NO. 02 Auto Mode —— Permission UI的静默革命

发布会第三行脚注:"Auto mode扩展到Max用户"。就一句话。

Anthropic官网原话:"auto mode is a new permissions option where Claude makes decisions on your behalf."——"代你做决策"。

过去一年所有agent创业公司在卷两个极端:要么skip-all-permissions一把梭(Devin、Cognition那条路),要么疯狂弹窗approve/deny(Cursor早期)。Anthropic走了第三条路:训练模型自己判断什么该问、什么不该问,并把这个判断力内化进auto mode。

KAI: Alan,这跟skip permissions有啥本质区别?不都是放手让它跑?

ALAN: 区别大了。skip是你把保险栓拔了,出事你负责。auto是模型自己装了一套保险——危险操作它主动停下问你,低风险自己处理。本质是把"permission UI"这一整层,从产品外壳挪到了模型权重里。

TONY: 所以YC那一堆做"agent治理/guardrails"的初创…

ALAN: 产品等于被做进模型了。这就是Andrej去年说的"the model is the product",活生生的例子。

KILL LIST → Agent guardrails/approval-flow SaaS——那些做"人机协同审批平台"的,整个品类被降维

→ RPA传统行业(UiPath/Automation Anywhere)——它们的核心价值就是"可控的自动化",现在可控自己内生了

→ BPO外包行业的中后台——菲律宾印度那些数据录入、客服分派、发票对账,auto mode跑一天,一个团队的活

—— BLADE NO. 03 /ultrareview——给Senior Engineer的一张刺杀令

官网用词:"a dedicated review session that reads through changes and flags bugs and design issues that a careful reviewer would catch." 注意那个词——"a careful reviewer"。不是junior,不是linter,是"careful reviewer"。翻译成人话:senior engineer。

CodeRabbit的David Loker给的数字更直接:recall涨10%以上,在最复杂的PR里面挖出最难抓的bug,precision几乎没掉。recall涨、precision不掉——code review领域里,这就是holy grail,上一个拿到这个组合的叫Google内部的Tricorder,做了十年。

MARCUS: 我们FAANG一个staff eng一年$800K,review PR占一半时间。这东西如果真能打…

ALAN: Pro和Max用户免费给三次ultrareview,让你试毒。这是硅谷惯用的"freemium下毒"套路——给你尝到味道,再让你回不去。

MARCUS: 所以这不是工具,是替身。

ALAN: 不完全。它不替掉staff,它替掉staff每天下午review十个PR那两小时。释放出来的那两小时,senior才是senior,不是人肉GitHub bot。

◆ 落地场景

一个二十人工程团队,原来tech lead每天花三小时review PR。上/ultrareview,tech lead只需要看Claude标红的那几个"design issue"——三小时变二十分钟,省下的时间真的去做架构。这不是"AI辅助",是岗位职责重写。

KILL LIST → 所有独立的AI code review创业公司——CodeRabbit、Codacy、Qodo,它们现在是Anthropic的feature

→ SAST/DAST传统安全扫描工具(Snyk/Checkmarx)——规则驱动的静态扫描,被"像人一样读代码"的方式碾过

→ 印度/东欧外包code review服务——这个市场过去十年估值几十亿美金,现在直接蒸发

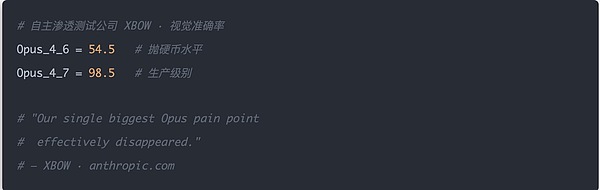

—— BLADE NO. 04 2,576像素视觉——Computer-Use从Demo变武器

"可接受图像最长边到2,576像素,约3.75兆像素,是之前三倍多。"

这一条最被低估。大部分人看到就觉得"哦更高清了"。错得离谱。这是computer-use这整个品类从demo进入production的分水岭。

证据在发布页最下面那个引用块里, XBOW的CEO Oege de Moor说的一句话——

54.5% → 98.5%。这不是一个渐进的提升,这是一个从"不能用"到"不能不用"的跃迁。Opus 4.6还在猜屏幕上的按钮在哪,4.7已经能读密集仪表盘上的小字和嵌套表格。

SARAH: 我们企业客户一直卡在这个点。4.6让它自动处理发票扫描件,错一半——老板直接说"别玩了"。

ALAN: 现在98.5%这个数字,意味着RPA、IT运维、报销审计、老系统搬迁——所有还靠人眼看屏幕的工作流,第一次有了可以接受的托底模型。

KAI: computer use不再是demo video,是生产力。

ALAN: 对,而且注意——这是模型层面的升级,不是API参数。老用户什么都不改,自动吃到。Anthropic在悄悄把所有集成方的产品力往上推一截。

KILL LIST → OCR/文档理解SaaS(Rossum/Hyperscience/Nanonets)——它们的moat本来就是"视觉+结构化",现在被通用模型追平甚至超过

→ 传统RPA三巨头——UiPath的屏幕识别核心技术,价值一夜蒸发一半

→ 企业应用数据录入部门——医疗保险理赔、银行KYC、政府表格处理,整条人肉流水线

→ 自主渗透测试/red team行业——XBOW这种公司反而吃到红利,但传统pentesting顾问服务被打穿

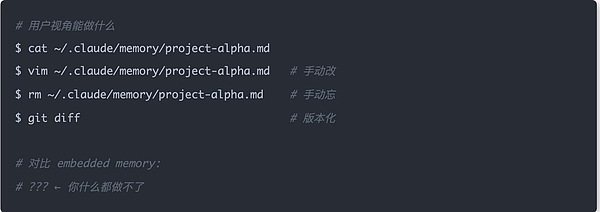

—— BLADE NO. 05 File-System Memory——Anthropic选了最朴素那条路

发布会一条脚注:"Opus 4.7 is better at using file system-based memory. It remembers important notes across long, multi-session work."

OpenAI走的是"embedded memory"——把记忆糊在模型里,你看不到、也改不了。Google在搞神秘的infini-attention。Anthropic这次亮牌了:文件系统就是记忆。

Claude写.md笔记,读.md笔记,你随时能cat出来看。

这个选择看似low-tech,实际上是第一性原理的胜利。记忆的核心问题从来不是存储,是可审计、可编辑、可迁移。

向量数据库和embedded memory都违背这三点。

ERIC: 企业客户最怕的就是"这AI到底记住了我什么,我不知道"。

ALAN: 文件系统记忆直接解决合规。GDPR删除权?rm一下。SOC2审计?cat给审计师看。这不是技术优势,是法律优势。

ERIC: 所以那些做"AI memory layer"的创业公司…

ALAN: Mem0、LangMem、Zep——这一年融了不少钱。它们解决的是"模型自己不会管记忆",Anthropic把这个能力写进了模型里,而且用的是最朴素的POSIX文件系统。中间层被跳过。

KILL LIST → AI Memory基础设施初创(Mem0/LangMem/Zep)——价值主张被内化到模型

→ 部分向量数据库的agentic memory使用场景——Pinecone、Weaviate的一条主要叙事受影响

→ 企业知识管理SaaS的AI增强层——不需要第三方中间件了,Claude直接读写项目文件

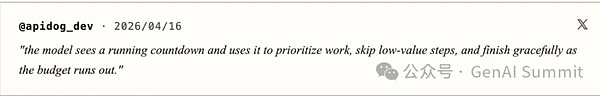

—— BLADE NO. 06 Task Budgets——给Agent装刹车,然后松开油门

"Giving developers a way to guide Claude's token spend so it can prioritize work across longer runs."(public beta)

这个被所有媒体漏掉了,但它是长程agent这一年最重要的工程突破。

过去一年所有agent公司都在对同一个恶魔:长任务的token失控。给Devin或者Cursor一个复杂任务,它自己跑两个小时,回来告诉你烧掉了$800,活儿只干了一半。老板看到账单眼睛都绿了。

Task budget的设计非常巧妙——不是简单的token上限,而是让模型自己看到预算在倒数,自己决定跳过哪些步骤、怎么把活儿做到最关键的完成度。

CLAIRE: 这不就是工程项目管理的"最小可交付"思维?

ALAN: 对。Anthropic把scope-cutting这个PM技能,训进模型了。给你$10预算跑agent,它会自己决定哪个功能做到80%就收,哪个必须做到100%。

TONY: 所以Notion那个quote——"implicit-need tests"第一个能通过——

ALAN: 对上了。模型开始有"资源意识",能猜出你没说但期望的东西,在预算内优先保。这是把"senior engineer judgment"训进去了。

KILL LIST → AI cost-control/LLM可观测创业(Helicone/Langfuse成本模块)——核心功能被native化

→ Agent orchestration框架(部分LangGraph/CrewAI用法)——模型自己能规划预算,不需要外层调度

→ 传统咨询行业的项目管理部分——"资源分配+交付裁剪"这一层智力,被模型干了

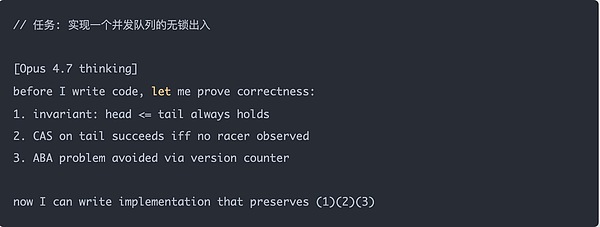

—— BLADE NO. 07 写代码前先做Proof——Vercel发现的新行为

Joe Haddad, Distinguished Eng at Vercel: "It even does proofs on systems code before starting work, which is new behavior we haven't seen from earlier Claude models."

这一句被埋在二十多条quote里面,没人放大。但老OG读到这儿直接把咖啡放下了。

"proofs on systems code"——在写系统级代码之前,模型会先自己做数学/形式化证明。这不是更聪明的意思,这是模型开始在用跟PhD验证论文一样的方法验证自己的代码。

MARCUS: 这个行为出现在训练数据里,说明Anthropic在RL阶段明确奖励了"先证明后写码"。

ALAN: 对,这是有意识地训练出来的。组合Vercel那段和Genspark的"loop resistance"、以及Hex的"correctly reports when data is missing instead of plausible-but-incorrect fallbacks"——你看到的是一个完整的品味训练工程:让模型开始像不好骗的工程师一样工作。

MARCUS: 不好骗——意思是不自欺。

ALAN: 对。Opus 4.7不再为了完成任务而给你编一个看起来能跑的方案。这是alignment实打实落到产品层面的一次体现。

KILL LIST → 形式化验证工具细分市场(部分)——Coq/Lean/TLA+这些高门槛工具的一部分入门场景,模型自己帮你搞

→ 高频交易/区块链安全审计行业——审计员核心工作("读代码找不变量违反")被模型协作化,审计单价被压

→ 操作系统内核/嵌入式外包——那些需要proof-based reasoning的细分,门槛被拉平

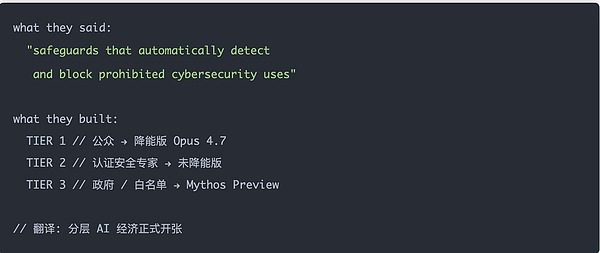

—— BLADE NO. 08 Cyber Verification——监管套利的窗口被打开了

"During its training we experimented with efforts to differentially reduce these capabilities."

最骚的操作在这里。Anthropic承认在训练过程中主动降低了Opus 4.7的网络攻防能力,因为背后那个更强的Mythos Preview不放出来。然后——

然后他们开了一个Cyber Verification Program,让合法的安全研究员、pentester、red team认证后可以解锁更高权限。

ERIC: 这…这不就是出口管制的模型版?

ALAN: 更准确地说,是"能力KYC"。模型有三层能力闸门,你证明身份才能解锁相应层级。监管套利的窗口第一次被AI公司自己明码标价。

ERIC: 对创业公司意味着什么?

ALAN: 第一,通用"AI + 安全"的创业,想做高端场景得先拿Anthropic的认证,供应链本身就被管。第二,一个全新的品类会出现:帮你通过Anthropic认证的咨询服务——就像今天帮你通过SOC2的公司一样。第三,这是Anthropic在练手未来所有frontier model的放出方式,Mythos放出来只会更严。

TONY: 所以Palantir、Booz Allen这种政府合规身家的公司…

ALAN: 白捡一层护城河。他们本来就有清算级身份,现在天然解锁顶层模型。

◆ 落地场景

一个想做AI pentesting的YC创业者,2026年Q2起,商业计划书第一页必须回答"你们有没有拿到Anthropic Cyber Verification"。没有?VC不投。拿到?估值乘2。一个认证,资本市场的分水岭。

KILL LIST & 新赛道

→ 通用网络安全创业SaaS——没有Anthropic认证的,拿不到上层模型能力,天花板被锁死

→ "AI模型能力合规咨询"新赛道诞生——未来12个月会冒出一批帮企业做frontier model认证的中介

→ 传统军工、政府系集成商(Palantir/Booz Allen)——天然受益,门槛变成护城河

→ 开源/本地部署阵营——Llama、Qwen、DeepSeek路线反而受益,"不认证也能用"成为核心卖点

窗外California Ave的太阳已经爬过Palo Alto Creamery的屋顶,斜光打在玻璃上。

"八把刀,砍向八个方向。有些赛道今天开始死,有些今天开始生。"

"每一代frontier model的发布,真正的东西都不写在Headline上。"他对Tony说,"发布会是给分析师看的。脚注和quote里的数字,才是给我们看的。"

"别看热闹。"

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯