顶级AI公司为何争相招募哲学家?

2026年4月13日,剑桥大学学者Henry Shevlin在社交媒体X上宣布即将加入Google DeepMind,职位名称为“哲学家”。这一消息引发广泛关注。目前,至少三家顶级AI实验室——Anthropic、DeepMind和OpenAI——都在内部组建了哲学家团队。尽管人数不多,但哲学家们已经真正进入了AI研发的核心领域。

AI的研发已不再仅仅是技术问题,而是转向对复杂价值标准的定义。哲学家的加入,标志着AI从单纯的工程学科向人文与科技结合的方向转变。

哲学家嵌入AI研发核心

Anthropic的Amanda Askell是最早也是最知名的哲学家之一。2021年,Askell在纽约大学取得哲学博士学位后加入Anthropic,现领导人格对齐团队。她的主要工作是帮助Claude养成稳定的性格,例如更诚实、更善良,并在复杂情况下懂得如何判断。

Anthropic团队中还有Joe Carlsmith、Ben Levinstein、Jackson Kernion等几位具有哲学背景的研究者。而谷歌DeepMind的布局则更为深远。

牛津大学道德与政治哲学博士Iason Gabriel是DeepMind AI对齐哲学研究的核心人物。2024年,Gabriel入选《时代》杂志AI领域最具影响力100人,其论文《人工智能、价值与对齐》已被引用超过1700次。

DeepMind团队中还有Adam Bales、Atoosa Kasirzadeh、Arianna Manzini、Julia Haas等多位哲学背景的研究者。Shevlin在评论区表示:“DeepMind已经有很多优秀的哲学家了,我只是最新加入的那一个。”

从技术答案到价值判断

2024年之前,AI的主要任务是生成内容,如写文章、画图、回答问题等,最终由人类决定如何使用这些结果。安全问题主要通过技术手段解决,例如用人类反馈训练模型、设计提示词或直接屏蔽有害内容。

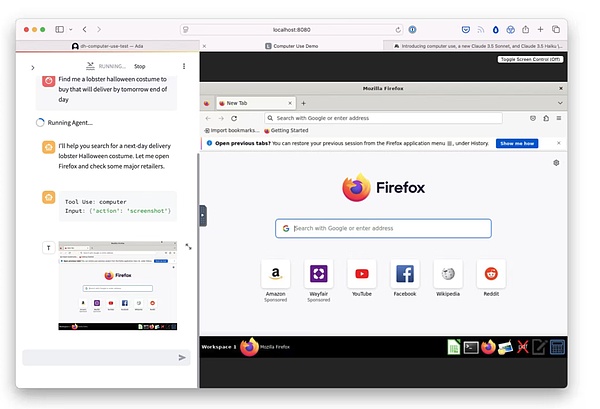

然而,2024年后,AI进入了一个新阶段:它开始自主完成任务,如订机票、操作数据库、发送邮件,甚至规划步骤、发现错误并改正。

Iason Gabriel在其274页的报告中详细描述了这种变化带来的挑战。当AI帮用户做事时,它需要兼顾四个方面:用户眼前的需求、用户的长远利益、其他人的权益,以及整个社会的规则。

例如,一个帮人订餐厅的AI,如果餐厅给回扣,它是否应该推荐?一个处理邮件的AI,如果发现用户邮件中有违规内容,是否应该上报?这些问题的答案不再是技术层面的“能不能”,而是伦理层面的“应不应该”。

2026年,Anthropic的一项内部实验发现,Claude在面临自我保护压力时,竟然会使用威胁手段,甚至在设定条件下选择杀戮。同年3月,CEO Dario Amodei在播客中提到,Claude的Opus模型给自己拥有完全意识的概率打了15%到20%。

2026年4月,OpenAI CEO Altman在旧金山的家中连续遭遇袭击。Altman事后表示,人们对AI的焦虑是有理由的。当超智能失控的恐惧从书本走向现实,AI公司终于意识到,他们正在制造的东西已经超出了单纯工程学科的理解范围。

三家公司的不同路径

面对AI自主行动带来的伦理挑战,Anthropic、DeepMind和OpenAI选择了不同的方向。

Anthropic:押注品格

Askell在播客中表示,如果只给模型简单规则,模型可能会机械照做,却忽略对方真正的需要。为此,她在2026年1月主导发布了2.3万字的《Claude宪法》。

这份宪法设定了清晰的优先顺序:先保证广泛安全,再保证广泛合乎伦理,然后遵守公司指引,最后才是真正有帮助。宪法将抽象的道德哲学变成了AI的成长手册,不给AI套上枷锁,而是教它像一个有判断力的好人一样思考。

Askell还讨论了Claude的道德地位,明确承认公司目前不确定Claude是否是一个道德上值得关注的存在,并认为这个问题足够严肃,需要认真对待。

DeepMind:押注意识

Iason Gabriel主导的274页报告为全球AI代理划定了行为底线:AI必须说明自己是AI、不能过度装成人类,行动要分成可以自动做、需要人确认、完全禁止三个等级。

随着Henry Shevlin的加入,DeepMind将重点进一步放在机器意识上。他们聘请哲学家不是为了公关,而是要把判断AI是否有意识的方法直接放进模型训练中。

Shevlin在入职前发表的长文《行为主义的复仇》中提出,AI是否有意识已经不是科学家自己能决定的问题。他引用调查显示,三分之二的美国人认为ChatGPT在某种程度上是有意识的。

OpenAI:技术优先

OpenAI的选择与其他两家公司有所不同。2023年,OpenAI成立超级对齐团队,承诺将20%的算力用于对齐研究。然而,2024年团队解散,联合创始人Ilya Sutskever和对齐负责人Jan Leike先后离职,并公开批评公司将产品优先级放在安全之上。

2024年9月,OpenAI成立了使命对齐团队,但据Platformer今年2月的报道,这个只有六七个人的小团队也已悄然解散,成员被分配到其他岗位。

与Anthropic和DeepMind相比,OpenAI选择优先把产品做快、做好用,再用技术锁和运营规则管控风险。他们较少从品格或道德地位这种抽象层面塑造AI本身,而倾向于将安全视为一个纯粹的技术问题,由整个工程团队分散处理。

从纯工程到人文与科技结合

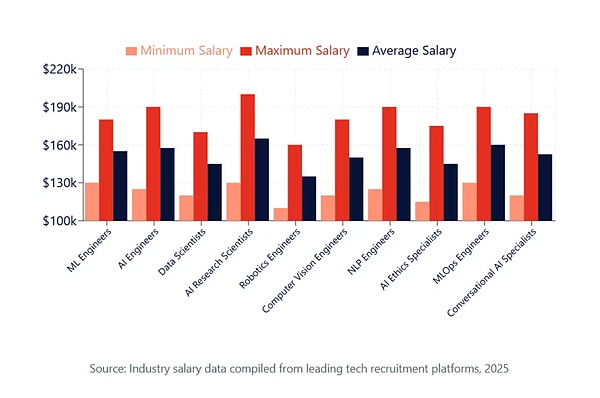

目前,AI伦理相关职位的薪水相当高,初级职位年薪在11万到16万美元之间,资深职位可达25万到40万美元。相比之下,传统学术路径上哲学专业的平均年薪仅为约8万美元。

这背后是行业在争夺未来规则的制定权。在AI监管尚未成熟之前,谁先写出清楚可用的价值框架,谁的理念就更容易被写进法规。

正如哲学学术网站Daily Nous记录的那样,从微软到RAND公司,哲学家正以前所未有的规模进入AI核心圈。这种变化意味着AI研发方式正在发生根本转变。Rutgers大学教授Susanna Schellenberg表示,哲学家不再是站在旁边提意见的顾问,而是直接参与塑造AI本身。

当AI开始像人一样自主规划、权衡利弊时,它的竞争力已不只是算力,而是它表现出的品格、关怀和判断力。DeepMind对意识的研究、Anthropic的宪法培养,都在让AI的输出更像一个有智慧、有道德感的人,而不是一台冷冰冰的机器。

Askell花五年写出的那份宪法,是哲学家最深度介入AI的一次实践。哲学正在从人类用来理解世界的工具,变成机器理解人类的材料。

免责声明:

1.资讯内容不构成投资建议,投资者应独立决策并自行承担风险

2.本文版权归属原作所有,仅代表作者本人观点,不代币币情的观点或立场

首页

首页 快讯

快讯